| Category | Tutorial Title | 概要 |

| アカウントの管理 | Increase account service quotas with Service Quotas | Service Quotasを使用したクォータ緩和申請方法、現在までのリクエスト確認。 |

| ※入門 | Getting Started with the AWS Management Console | コンソールホーム、アカウント情報、AWS リージョンを切り替、コンソールホームでの操作方法 |

| Visualize data in Amazon RDS for SQL Server using Amazon QuickSight | ||

| Build a training dataset with Amazon SageMaker Ground Truth | ||

| Create business intelligence dashboards with Amazon QuickSight | ||

| Optimizing Amazon EMR clusters for cost and scale with EC2 Spot Instances and Amazon EMR | ||

タグ: AWS

Machine Learning

基礎知識

●RAG(Retrieval-Augmented Generation:検索拡張生成)

外部の知識データベースから情報を検索し、それを使って自然言語を生成する仕組み。

(わからないことは調べてから回答するAI)

①検索(Retrieval):ユーザーの質問に対して、外部のデータベースやドキュメントから関連情報を検索。

②生成(Generation):検索結果をもとに、AIが文脈に沿った回答を生成。

[メリット]

- 最新情報に対応:学習済みモデルでは扱えない新しい情報も検索で補える。

- ハルシネーション対策:信頼できる情報源を参照することで、誤った回答を減らせる。

- 企業独自の知識活用:社内文書やFAQなどを活用して、業務に特化した回答が可能。

●ハイパーパラメーター

機械学習モデルの学習プロセスや構造を制御するために、事前に設定するパラメータ。人間が設計段階で決める設定値。

(モデルが自動で学習する「パラメータ(重みやバイアス)」とは異なる)

[学習プロセス]

・学習率:重みの更新幅。大きすぎると発散、小さすぎると収束が遅い。機械学習における「学習率」は学習の安定性にどう影響するかを意味する。学習率を適切に下げることで損失の振動を抑え、学習を安定させることができる。

- 学習率が高い場合の問題点

モデルの学習が大きく進みすぎるため、損失(モデルの誤り度合い)が安定せず、下がったかと思うとまた上がるという「振動」が発生します。これは、損失が最も小さくなる最適解の地点を通り過ぎてしまうことが原因。 - 学習率を下げることの効果

学習率を下げると、モデルはパラメータをより慎重に少しずつ調整するようになります。これにより、損失の振動が抑えられ、安定して最小値に向かって学習が進みます。その結果、モデルの性能も向上する。

・バッチサイズ:一度に学習するデータの数。

・エポック数:データセットを何回繰り返して学習するか。

[チューニング方法(アルゴリズム)]

| 手法名 | 探索方法 | 計算コスト | 特徴 | 向いている場面 |

|---|---|---|---|---|

| グリッド サーチ | 全組み合わせを網羅的に試す | 高い | 確実だが非効率。パラメータ数が多いと爆発的に試行数が増える | パラメータが少なく、計算資源に余裕があるとき |

| ランダム サーチ | パラメータ空間からランダムに抽出 | 中程度 | 意外と効率的。最適解に近い組み合わせに早く到達することもある | パラメータが多く、ざっくり良い結果を得たいとき |

| ベイズ 最適化 | 過去の試行結果から次の候補を予測 | 低~中 | 賢く探索。少ない試行回数で高精度に到達可能 | 評価に時間がかかる/試行回数が限られるとき |

| ハイパーバンド | ランダム探索+早期停止の組み合わせ | 低 | 効率的にリソース配分。性能が悪い試行は早期に打ち切る | 大規模な探索でリソース節約したいとき |

[ハイパーパラメータとパラメータの違い]

- パラメーター:モデルが学習によって自動的に決定する値(例:重みやバイアス)

- ハイパーパラメータ:学習前に人が設定する調整項目(例:学習率やエポック数)

◇学習モデル

データとラベルを使ってパターンを学習する。以下4種が存在する。

| モデル名 | 説明 | 代表的なアルゴリズム / モデル |

|---|---|---|

| 教師あり学習 例:売上予測、画像分類、スパム検出 | 正解となるラベル(教師データ)が付与されたデータセットを用いて学習する。入力データに対する正解を予測する。主に「分類」と「回帰」の2つのタスクに利用される。 | ・決定木 ・ロジスティック回帰 ・サポートベクターマシン ・ナイーブベイズ ・ランダムフォレスト |

| 教師なし学習 例:顧客セグメント分析、次元削減、異常検知 | 正解ラベルのないデータから、データに潜む構造やパターンを自律的に見つけ出す。データのクラスタリング(グループ分け)や次元削減(データの圧縮)などを行う。 | ・クラスタリング ・次元削減 ・自己符号化器 |

| 強化学習 例:ゲームAI、ロボット制御、広告最適化 | エージェントが環境の中で試行錯誤し、報酬を最大化するように学習する手法。環境と相互作用しながら最適な行動戦略を見つけます。 | |

| 深層学習 (ディープラーニング) | ニューラルネットワークを多層にしたもので、データから特徴量を自動的に学習。教師あり、教師なし、強化学習のいずれのフレームワークでも使用される。 | ・畳み込みニューラルネットワーク ⇒ 画像認識に特化 ・リカレントニューラルネットワーク ⇒ 時系列データ、自然言語処理に特化 ・トランスフォーマー ⇒ 自然言語処理、生成AIで広く利用 |

教師アリ

●分類

ラベル付きデータを使ってカテゴリを予測(例:スパム判定、画像分類)

| Accuracy(正解率) | 正解の予測数の割合を測定。 |

| Precision(適合率) | 正と予測されたもののうち、実際に正である割合を測定。 |

| Recall(再現率) | 実際に正であるもののうち、正と予測された割合を測定。 |

| F1-Score(F1スコア) | PrecisionとRecallの調和平均。バランス良く評価できる。 |

| ROC-AUC(ROC曲線下面積) | ROC曲線の下の面積を測定し、モデルの判別能力を評価。 |

| Logarithmic Loss(ロジ損失) | 予測確率の精度とクラス間の誤差を測定。 |

| Confusion Matrix(混同行列) | 各クラス間の予測結果を表形式で表示。 |

※混同行列(Confusion Matrix)

機械学習では、以下の4つの分類結果を混同行列で整理する。

| 実際のクラス | 予測が陽性 | 予測が陰性 |

|---|---|---|

| 陽性(True) | 真陽性(TP) | 偽陰性(FN) |

| 陰性(False) | 偽陽性(FP) | 真陰性(TN) |

分類問題(二値分類)では「偽陽性」と「偽陰性」はモデルの性能を評価するうえで非常に重要。

- 偽陽性(False Positive)

実際には「陰性(例:スパムではない)」なのに、モデルが「陽性(例:スパム)」と予測してしまうこと。

[例] 通常のメールをスパムと誤判定 → ユーザーが重要なメールを見逃す可能性あり。

[影響] 誤検出。不要なアラートや誤った処理が発生する。 - 偽陰性(False Negative)

実際には「陽性(例:スパム)」なのに、モデルが「陰性(例:通常メール)」と予測してしまうこと。

[例] スパムメールを通常メールと誤判定 → ユーザーが危険なリンクをクリックする可能性あり。

[影響] 見逃し。本来検出すべき対象を見逃す。

※偽陰性の予測コストが高い時、「再現率」を優先して向上させると改善の傾向にある

●回帰

数値の連続値を予測(例:売上予測、気温予測)

- 線形回帰分析(Linear Regression)

回帰線は直線であり、連続値を予測するタスク。入力変数(特徴量)に基づいて数値で表される目標変数(出力値)を推定する。評価には平均絶対誤差(MAE)や平均二乗誤差(MSE)などの指標が使われ、予測値と実際地の誤差を測定する。

・目的:連続値の予測(例:価格、点数、身長など)

・数式:出力 y は実数値(例:住宅価格が 42,000 USD) - 分類回帰分析(Logistic Regression)

回帰曲線はS字型(シグモイド)であり、カテゴリを予測するタスク。入力変数(特徴量)に基づいて、離散的なラベルやクラスを割り当てる。評価には正解率、F1スコア、ROC-AUCなどが使われ、予測モデルの正確さや判断能力を測定する。出力を閾値(例:0.5)で分類。コスト関数はクロスエントロピー(Log Loss)。

・目的:カテゴリ分類(例:Yes/No、陽性/陰性、スパム/非スパム)

・数式(シグモイド関数):出力 y は確率値(0〜1)

| Mean Absolute Error(平均絶対誤差) | 実測値と予測値の絶対差の平均。モデルがどれだけ正確に対象の価格を予測できているか、具体的な金額単位で直感的に把握できる。また、他の指標に比べて外れ値の影響を受けにくい。これは外れ値を含む可能性のあるデータセットにおいて、信頼性の高い評価ができる点で非常に適している。 |

| Mean Squared Error(平均二乗誤差) | 実測値と予測値の二乗誤差の平均。 |

| 二乗平均平方根誤差(RMSE) | MSEの平方根。 |

| R²(決定係数) | モデルがデータの分散をどれだけ説明するかを評価。 |

●時系列予測

過去のデータから未来を予測(例:株価、需要予測)

| Mean Absolute Percentage Error(MAPE、平均絶対百分率誤差) | 実測値に対する予測誤差の割合を測定。 |

| 平均重み付き分位点損失 (wQL) | P10、P50、P90 の分位点で精度を平均して予測を評価。値が小さいほど、モデルの精度が高くなる。 |

| 重み付き絶対誤差率 (WAPE) | 絶対目標値の合計で正規化された絶対誤差の合計で、予測値と観測値との全体的な偏差を測定。値が小さいほどモデルの精度が高いことを示し、WAPE = 0 はエラーのないモデル。 |

| 二乗平均平方根誤差 (RMSE) | 平均の二乗誤差の平方根。RMSE 値が小さいほどモデルの精度が高いことを示し、RMSE = 0 はエラーのないモデル。 |

| 平均絶対スケーリング誤差 (MASE) | 単純なベースライン予測法の非平均絶対誤差で正規化された予測の平均絶対誤差。値が小さいほどモデルの精度が高いことを示し、MASE < 1 はベースラインよりも精度が高いことを示し、MASE > 1 はベースラインよりも精度が引くことを示す。 |

| Root Mean Squared Logarithmic Error(RMSLE、平方平均対数二乗誤差) | 対数スケールで誤差を測定。 |

教師アリ+深層学習

●翻訳

入力文と対応する訳文を使って学習(例:Transformer、Seq2Seq)

| BLEU(BLEUスコア) | 生成された翻訳と参照翻訳のn-gram一致率評価。 |

| ROUGE(ROUGEスコア) | BLEUに単語と語形変化への対応を加えた指標。 |

| ROUGE(ROUGEスコア) | 生成テキストのリコール指標。 |

| BERTScore(BERTスコア) | 埋め込みモデルを用いて、生成文と参照文の意味的類似度を評価。 |

| Perplexity(困惑度) | 生成された文の予測精度を評価。 |

●画像認識

CNNなどを使って画像からラベルを予測(例:顔認識)

| Intersection over Union(IoU、交差面積比) | 検出領域と、予測領域と実際の領域の重複率を評価。 |

| Mean Average Precision(mAP、平均適合率) | 複数クラスの検出タスクでの精度を評価。 |

教師アリ+生成モデル

●生成(自然言語生成など)

GAN、VAE、拡散モデルなどで新しいデータを生成

| BLEU(BLEUスコア) | 翻訳同様、生成されたテキストの品質を評価。 |

| ROUGE(ROUGEスコア) | 翻訳同様、生成テキストの品質を評価。 |

| BERTScore(BERTスコア) | 翻訳同様、生成テキストの品質を評価。 |

教師ナシ

●クラスタリング

ラベルなしデータをグループ化(例:顧客セグメント分析)

| Silhouette Score(シルエットスコア) | クラスタリングの品質を評価、クラスタ間の距離とクラスタ内の密集性を考慮。 |

| Davies-Bouldin Index(デイビス・ボルダン指数) | クラスタリングの分離度と緊密さを評価。 |

| Adjusted Rand Index(調整ランド指数) | クラスタリング結果と実際のラベル間の一致度を評価。 |

強化学習

教師アリ+教師ナシ+強化学習

●推薦システム

協調フィルタリングや強化学習を組み合わせることが多い。

| Mean Reciprocal Rank(MRR、平均逆順位) | 正解の候補が結果リストでどれだけ上位にあるかを評価。 |

| Normalized Discounted Cumulative Gain(NDCG、正規化割引累積利得) | 関連度に基づいて推薦結果の品質を評価。 |

| Hit Rate(ヒット率) | 推薦リストに正解が含まれるかを測定。 |

●ドリフト

※別称:「モデルドリフト」、「モデルの陳腐化」

機械学習において、何らかの「予期せぬ変化」が原因で、モデルの予測性能が時間経過とともに劣化していく現象を指す。

| コンセプトドリフト | 入力データ(特徴量)と正解ラベル(目的変数)との関係性自体が、モデルを訓練した時から変化してしまうことを意味する。このドリフトが起こると、モデルは新しいデータのパターンを正確に予測できなくなり、「F1スコア」のような品質評価指標が低下する。「何(入力)から何を(出力)予測するかのルール自体が変わってしまう」こと。 |

| データ ドリフト | モデルを訓練した時の入力データの統計的な分布と、実際にモデルが使用される本番環境での入力データの統計的な分布がズレてしまうことを指します。「特徴量ドリフト」や「共変量シフト」とも呼ばれる。「入力されるデータの傾向が変わってしまう」こと。 |

●特微量エンジニアリング

| ※特微量とは… モデルにとって意味のあるデータの属性(列),モデルの予測精度に大きく影響するため、非常に重要な要素。 [例] 年齢、性別、購入履歴、Webサイトの滞在時間など |

機械学習モデルの性能を向上させるために、入力データ(特徴量)を加工・変換・選択するプロセスのこと。

・高性能なモデルでも、入力データが悪ければ精度は上がらない

・特徴量エンジニアリングによって、モデルの学習効率や予測精度が大幅に向上する

・特にKaggleなどのデータ分析コンペでは、最終順位を左右する要因になることも多い

[特徴量の学習プロセス]

| プロセス | 内容 |

|---|---|

| データ理解と探索 (EDA) | ・データの構造・分布・欠損・外れ値を把握 ・目的変数との関係性を可視化(ヒートマップ、散布図など) |

| 特徴量の作成 (Feature Creation) | 生データから新しい特徴量を生成 ・例: 年と月→年月 ・売上 = 単価 × 数量 |

| 特徴量の変換 (Feature Transformation) | ・スケーリング(標準化・正規化) ・対数変換、ビニング、ラベルエンコーディングなど |

| 特徴量の選択 (Feature Selection) | ・相関係数、情報利得、Lassoなどで重要な特徴量を選定 ・不要な特徴量を除去して過学習を防止 |

| モデル学習 (Model Training) | ・選定した特徴量を使ってモデルを構築 ・学習アルゴリズムに応じて特徴量の影響が変化 |

| モデル評価と特徴量の再設計 | ・精度・再現率・F1スコアなどで評価 ・特徴量の改善点を洗い出し、再設計 |

| 本番環境への導入とモニタリング | ・特徴量の生成ロジックをパイプライン化 ・データの変化に応じて特徴量を更新 |

[手法一覧]

| 欠損値処理 | ・平均・中央値補完:df.fillna(df.mean()) ・KNN補完:近傍データから推定 ・欠損フラグ追加:欠損の有無を新たな特徴量に |

| カテゴリ変数の変換 | ・ワンホットエンコーディング:カテゴリを0/1のベクトルに変換。機械学習を使う際の前処理の1つ。 たとえば、 “性別” という特徴量は、男 / 女の2種類の値をもつ。これをカテゴリ変数と呼ぶ。しかし値が文字になっているため、そのままだと機械学習の学習器に入れることができないため、”オリジナルの特徴量”_”値” で新しくヘッダを作り、値を 1 or 0 で表現することで、機械学習の学習器に入れることが可能となる。この新しく 1 or 0 で表現する方法を、one-hot エンコーディングという。 ・ラベルエンコーディング:カテゴリを整数に変換 ・ターゲットエンコーディング:目的変数の平均でカテゴリを数値化 |

| 数値変数の変換 | ・標準化(Zスコア):平均0・分散1に変換 ・正規化(Min-Max):0〜1の範囲にスケーリング ・対数変換: np.log1p(x)でスケール圧縮 |

| 外れ値処理 | ・IQR法:四分位範囲で検出 ・Zスコア法:標準偏差から逸脱を検出 ・外れ値フラグ化:外れ値かどうかを特徴量に |

| 時系列データの特徴量化 | ・ラグ特徴量:過去の値を現在の特徴に ・移動平均・差分:トレンドや変化量を抽出 ・曜日・月・時間帯:周期性の抽出 |

| テキストデータの処理 | ・Bag-of-Words / TF-IDF:単語頻度ベース ・Word2Vec / BERT:意味ベースの埋め込み ・文字数・単語数・記号数:構造的特徴量 |

| 特徴量の組み合わせ・生成 | ・交互作用項:例:売上 × 広告費・合成特徴量:例: 年と月→年月・条件付き特徴量:例: 雨の日の売上 |

| 次元削減・選択 | ・PCA(主成分分析) ・Lasso / Ridgeによる選択 ・相関係数・情報量による選択 |

●Min-Max正規化

データ全体を最小値0~最大値1の範囲に変換する方法。機械学習では、学習時と予測時でデータのスケールを揃えることが非常に重要であり、そのためにMin-Max正規化などの手法が一貫して適用される必要がある。

・正規化の目的: データのスケール(単位)を扱いやすいものに整えること。

・一貫性の重要性: モデルの予測精度を保つため、学習データと本番(予測)データで同じ方法・同じ統計値(最小値と最大値)を使って正規化する必要がある。

※Glue DataBrewの活用: このツールを使うと、学習データから計算した最小値・最大値の統計情報を保存し、本番データにも再利用できるため、一貫した前処理が保証され、データスキュー(データの偏り)を防ぐことができる。

◇過学習の防止方法

早期停止

学習が十分に進み、それ以上やると逆に性能が落ちそうになる一番良いタイミングで、賢くトレーニングをストップさせる手法。トレーニングを進めながら、モデルの性能を別途用意した「検証データセット」で常に監視します。そして、検証データセットに対する性能が向上しなくなった、あるいは悪化し始めた時点で、トレーニングを自動的に終了させる。

[メリット]

- 過学習の防止: モデルの性能が最大化された最適なタイミングで学習を止められる。

- 時間とコストの節約: 無駄なトレーニングを続けることを防ぎ、計算時間を短縮できる。

ドロップアウト

モデルのトレーニング中に、各層のニューロン(ノード)を一定の確率でランダムに無効化(一時的に無視)しながら学習を進める手法。この処理により、モデルが特定のニューロンや特徴の組み合わせに過度に依存することを防ぐ。

ネットワークは、より頑健で冗長性の高い表現を学習するようになり、未知のデータに対する予測性能である「汎化性能」が向上する。過学習を防ぐための効果的な「正則化」の手法として広く利用されている。

◇推論(予測)

学習済みの機械学習モデルに新しいデータを入力し、予測結果を得るプロセス。「学習」はデータから知識やパターンを学び、「推論」は学習済みの知識を使って新しいデータに予測や判断を行うプロセス。学習はモデルを「作る」段階、推論は作ったモデルを「使う」段階と考えることができる。

以下、推論処理の方式の種類。

[サポートされている出力形式]

application/json , application/x-recordio-protobuf , text/csv

| モデルタイプ | 出力内容 | 説明 |

|---|---|---|

回帰モデル (regressor) | score | 数値的な予測値(例:価格、温度など) |

| 分類モデル ( binary_classifier, multiclass_classifier) | score, predicted_la | scoreは予測の確信度、predicted_labelは予測されたクラス(例:スパム or 非スパム) |

| 推論方式 | 特徴 | 主な用途 |

|---|---|---|

| 同期推論 | 入力→即座に出力を待つ ⇒小規模モデル、リアルタイム応答が必要な場面 リクエストに対して即座にレスポンスを返す。リアルタイム性が高いが、待機時間が発生しやすい。 | チャットボット、音声認識、リアルタイム制御 |

| 非同期推論 | 入力→処理中に他の作業→後で出力を受け取る ⇒大規模モデル(GPT、BERT、画像生成モデルなど) | 画像生成、長時間推論、バッチ処理 |

| サーバーレス推論 | ・インフラの管理(サーバーの選択、設定、スケーリングなど)不要で機械モデルをデプロイ。 ・トラフィックの量に応じて、必要なコンピューティングリソースを自動で起動・停止。 ※CPUバースト用途に利用されることが多い ・ MaxConcurrency(同時実行リクエスト数)を1に設定することで、同時リクエスト数を制限できる。使用用途:予測する頻度が低い、トラフィックが断続的・予測不能なユースケースに最適。 コスト:従量課金制。リクエストがない時はリソースをゼロまでスケールダウン。(イベント駆動) | API連携、イベントベース処理、軽量推論 |

| バッチ推論 | 複数の入力をまとめて一括処理。効率的だがリアルタイム性は低い。 | レコメンド、ログ解析、定期処理 |

| ストリーム推論 | データストリームに対して継続的に推論。低レイテンシ処理に強い。 | IoT、センサーデータ、金融取引監視 |

| オンデバイス推論 | モバイルやエッジデバイス上で推論。通信不要で高速。 | スマホアプリ、ロボット、AR/VR |

●XG Boost(eXtreme Gradient Boosting)

勾配ブースティングを効率的に実装した オープンソースの機械学習アルゴリズム 。「弱いモデル(主に決定木)」を多数組み合わせて「強い予測モデル」を作る アンサンブル学習手法 の一種。

※簡単なイメージ

1本の決定木は「弱い予測器」だが、たくさんの木を「順番に」「誤差を修正しながら」作り足していくことで、精度の高い「強い予測器」を構築する。

| ディシジョンツリー (決定木) | データを段階的に分割し、分類や予測を行うシンプルなアルゴリズム。 ・ max_depth は決定木の深さを制御するパラメータ。・値が大きいとモデルが複雑になり過学習のリスクが高まる。 ・値を小さくすると複雑さが抑えられ、過学習を防止できる。 ・適切な max_depth を選ぶためにはクロスバリデーションが有効。・適切に制御することでモデルの汎化性能(未知データへの予測精度)が向上する。 |

| ※補足 | ・決定木の深さ(max depth):木の複雑さを制御。 ・隠れ層の数とユニット数(neural network):モデルの表現力に影響。 ・正則化係数(L1/L2):過学習を防ぐためのペナルティ。 |

[特徴]

| 高い精度 | 多くの機械学習コンペティション(Kaggleなど)で優勝に使われるほど精度が高い。 |

| 高速処理 | 並列処理やメモリ効率を工夫しており、大規模データでも学習が速い。 |

| 柔軟性 | 回帰、分類(二値・多クラス)、ランキング問題など幅広いタスクに対応。 |

| 過学習への対策 | max_depth や subsample など多数のハイパーパラメータでモデルの複雑さを制御できる。 |

| アルゴリズム | ・弱いモデルを組み合わせて正確な予測を行うアンサンブル学習手法。 ・多様なデータ型や分布、関係に対応可能で、ハイパーパラメータの微調整もしやすい。 |

[XGBoost ハイパーパラメータ分類表(完全版)]

| 分類 | パラメータ | 説明 |

|---|---|---|

| ツリーベースモデル用 (gbtree / dart) | max_depth | 木の最大深さ |

min_child_weight | 子ノードに必要な最小サンプル重み | |

gamma | 分割に必要な損失減少量(大きいほど単純な木になる) | |

subsample | 学習に使うデータの割合 | |

colsample_bytree | 各木の構築に使う特徴量の割合 | |

colsample_bylevel | 各階層で使う特徴量の割合 | |

colsample_bynode | 各ノード分割で使う特徴量の割合 | |

| ブースティング全般 | learning_rate(eta) | 各木の寄与度(学習率) |

n_estimators | 作成する木(モデル)の数 | |

booster | モデル種類(gbtree, gblinear, dart) | |

lambda(reg_lambda) | L2 正則化項 | |

alpha(reg_alpha) | L1 正則化項 | |

scale_pos_weight | クラス不均衡データへの重み付け | |

| 学習タスク | objective | 学習タスク(例: 回帰、分類、多クラス分類) |

eval_metric | 評価指標(例: rmse, logloss, auc) | |

seed | 乱数シード | |

| DART 特有 | sample_type | サンプリング方式 |

normalize_type | 正規化方式 | |

rate_drop | 木を間引く割合 | |

skip_drop | ドロップをスキップする確率 | |

| 線形モデル用 (gblinear) | updater | 学習アルゴリズム(例: shotgun, coord_descent) |

feature_selector | 特徴選択手法(例: cyclic, shuffle, random, greedy, thrifty) | |

top_k | 特徴選択で利用する上位 k(greedy のとき有効) |

Sage Maker

機械学習の構築。すべての開発者とデータサイエンティストに機械学習モデルを迅速に構築、トレーニング、デプロイできる手段を提供。PyTorchなどの主要なNL(自然言語)フレームワークに対応した事前作成済みコンテナイメージを提供しており、ユーザーは自作のPythonスクリプトをそのまま実行できる。

| 項目 | リアルタイム推論 [リアルタイム] | サーバーレス推論 [リアルタイム] | 非同期推論 [マイクロバッチ] | バッチ変換 [バッチ] |

|---|---|---|---|---|

| リアルタイム | リアルタイム | マイクロバッチ | バッチ | |

| 特徴 | 常時稼働するエンドポイント。低レイテンシ・高スループット対応。 | インフラ管理不要。使用時のみ課金。 | 長時間処理や大きなペイロードに対応。 | 大量データを一括処理。非同期で実行。 |

| 実行モード | 同期 | 同期 | ハイブリッド(同期/非同期) | 非同期 |

| 予測レイテンシー | 秒以下 | 秒以下 | 数秒~数分 | 不定 |

| 実行頻度 | 可変 | 可変 | 可変 | 可変/固定 |

| 呼び出しモード | 連続ストリーム/APIコール | 連続ストリーム/APIコール | イベントベース | イベント/スケジュールベース |

| 推論データサイズ | 小(<6MB) | 小(<6MB) | 中(<1GB) | 大(>1GB) |

| ユースケース | リアルタイムで推論結果が必要なケース、例えば、商品レコメンドなど | たまにしか推論しないケース、例えばドキュメントからのデータの抽出や分析など | 中規模のデータに対して非同期で推論ケース。例えばコンピュータビジョン、物体検知など | 大規模のデータに対して非同期で推論するケース。例えば、NLPなどデータサイズや推論処理が長いケースなど |

[Sage Maker 非同期推論について]

ペイロードサイズが大きく (最大 1 GB)、処理時間が長い (最大 1 時間)、ほぼリアルタイムのレイテンシー要件があるリクエストを処理できる。推論リクエストが処理されるまでの間、受信リクエストを「非同期キュー」に保存し、完了後に結果を S3 バケットに保存することで、処理が完了するのを待つ必要がなくなる。処理するリクエストがない場合、インスタンスカウントをゼロに Auto Scaling することによりコストを節約できるため、エンドポイントがリクエストを処理している場合にのみ料金が発生します。

・スケーリングポリシーを設定することで、リソースの使用状況に応じた「Auto Scaling」が可能となる。

機能性

| スクリプト モード | オンプレミス環境で作成した既存のスクリプトを最小限の変更で実行できる。これにより、独自のドメイン知識を反映したモデルを迅速にAWS上へ移行でき、運用コストや学習の手間を最小限に抑えられる。 「スクリプトモード」とは、SageMakerで用意されたアルゴリズムやコンテナを使うのではなく、独自のコンテナやライブラリを利用して学習処理を記述する方法のことである。 |

| バッチ変換 | 大規模なデータセットに対する非同期推論を効率的に処理するためのサービスであり、ジョブのスケジュール管理とスケーラブルな推論をサポートしている。この仕組みにより、要求された非同期処理要件を満たすことができる。 |

| ライフサイクル設定(LCC) | SageMakerのノートブックインスタンスが作成または起動されるたびに、あらかじめ用意したシェルスクリプトを自動的に実行させる。すべてのノートブックインスタンスに対して一貫した設定(パッケージのインストール、セキュリティ設定など)を自動で適用でき、手動での作業や運用上の負担を大幅に削減できる。 |

| バリアント 機能 | 1つのエンドポイントに複数のモデルや構成を同時にデプロイして、柔軟な推論運用を可能にする仕組み。特にA/Bテストやモデル比較に非常に有効。 ・Production Variant(バリアント) エンドポイントにデプロイされるモデルの構成単位。モデル名、インスタンスタイプ、インスタンス数、トラフィック重みなどを定義する。 ・マルチバリアントエンドポイント 複数のバリアントを同時にホストするエンドポイント。トラフィックを分散して複数モデルを評価できる。 ・TargetVariant 推論リクエスト時に、特定のバリアントを明示的に指定するためのパラメータ。 |

| シャドウ テスト | ユーザーからのリクエストを、本番環境で稼働中の機械学習モデル(本番稼働用バリアント)と新しいモデル(シャドウバリアント)の両方に送信することでパフォーマンスを実際のトラフィックで評価するための機能。 ユーザーへの影響なし: ユーザーには本番稼働中モデルからのレスポンスのみが返されるため、ユーザー体験を損なわずテストが可能。 データ収集: 新しいモデルのレスポンスは、S3などの内部的な場所に保存される。保存されたデータを分析することで、本番環境のデータを使って新しいモデルのパフォーマンス(推論のレイテンシーや正確性など)を評価し、本番環境にデプロイしても問題ないかを確認。 |

| マネージドウォームプール | 起動時間の短縮: 一度使ったインフラをすぐに再利用できるように待機させておくことで、次からのジョブの開始を速くする機能。トレーニングジョブに必要なインフラストラクチャを事前に準備しておき、ジョブが完了した後もそのインフラを保持。 この機能はSageMakerによって完全に管理されるため、ユーザーがインフラのセットアップや管理について負担を感じる必要はない。 |

| 分散 トレーニング | 分散トレーニングで、インスタンス間の通信遅延(レイテンシー)を減らすためには、以下の2点によりトレーニング時間の短縮と通信コストの削減につながる。 ①インスタンスを同じ場所に配置する トレーニングに使うすべてのインスタンスを、同じVPCサブネットに配置することで、ネットワーク経路が短縮され、通信のオーバーヘッドが減る。 ②データとインスタンスを同じ場所に配置する トレーニング用のデータを、インスタンスが稼働している同じAWSリージョンおよびアベイラビリティーゾーンに保存。これにより、トレーニング中のデータ転送時間が最小限になり、ネットワーク効率が向上する。 |

[暗号化]

| 暗号化の対象 | トレーニングクラスター内のノード間の通信は暗号化が可能。 |

| 暗号化されない通信 (サービスプラットフォーム内部) | サービスコントロールプレーンとトレーニングジョブインスタンス(顧客データではない)間のコマンドとコントロールの通信。分散処理ジョブや分散トレーニングジョブのネットワーク間のノード間通信。バッチ処理のためのノード間通信。 |

エンドポイント

動作:エンドポイントにリクエストを送ると、モデルが推論を実行し、結果を返す。

目的:トレーニング済みモデルをホスティングし、リアルタイムまたは非同期で推論リクエストを受け付ける。

[エンドポイントの種類]

| エンドポイント種別 | 特徴 | ユースケース |

|---|---|---|

| リアルタイム推論エンドポイント | 常時稼働。低レイテンシで即時応答。 | Webアプリ、API連携、チャットボットなど |

| 非同期推論エンドポイント | 長時間処理や大きなペイロードに対応。SNS通知も可能。 | 画像生成、音声処理、大規模データ分析など |

| バッチ変換 (Batch Transform) | エンドポイント不要。一括処理に特化。 | オフライン予測、事前データ処理 |

| サーバーレス推論エンドポイント | インフラ管理不要。使用時のみ課金。 | トラフィックが断続的なアプリケーション |

| マルチモデルエンドポイント | 複数モデルを1つのエンドポイントで管理。 | モデル切り替えが頻繁なシステム |

| マルチコンテナエンドポイント | 異なるコンテナを同時ホスト可能。 | 複数フレームワークの混在処理 |

| 推論パイプラインエンドポイント | 前処理・推論・後処理を連結。 | 複雑な処理フローやデータ変換付き推論 |

| 推論コンポーネント (Inference Components) | 生成AI向けの新機能。リソース効率化。 | Llama 3 や Mixtral などの大規模モデル推論 |

非同期推論では、結果はS3に保存され、SNSで通知を受け取ることも可能。

●リアルタイム推論エンドポイント

・利用シーン:リアルタイム、インタラクティブ、低レイテンシーが求められる推論に最適。

・Auto Scaling 対応:リクエスト数や需要の変動に応じてインスタンス数を自動調整。

・最適化された応答:リクエストサイズ(1KB~3MB)に対応し、低レイテンシーで推論。

・マネージドサービス提供:高可用性を確保し、運用負担を軽減。

●マルチモデルエンドポイント

複数の機械学習モデルを単一のエンドポイントでホスティングできる機能。これにより、推論コストの削減と運用効率の向上が可能になる。

[特徴と利点]

| 単一エンドポイントで複数モデルを管理 | モデルごとに個別のエンドポイントを作成する必要がなくなる |

| コスト効率が高い | 使用頻度の低いモデルも同じインスタンスでホスティングできるため、リソースの無駄が減る |

| スケーラブルな設計 | モデル数が増えてもエンドポイントの数は変わらず、運用が簡素化される |

| CPU/GPU 両方に対応 | 高速な推論が必要なモデルには GPU を割り当て可能 |

●SageMaker 推論コンポーネント

機能: 推論コンポーネントを利用することで、1つのSageMakerエンドポイントに対して複数のモデルを分離してデプロイできます。

メリット: リアルタイム応答を必要とするユースケースに適しており、柔軟かつ高可用な推論環境を実現できる。

[スケーリングの柔軟性]

- モデルごとに異なるスケーリングポリシーを適用できます。

- 推論コンポーネントの

minReplicaCountを $1$ 以上に設定することでコールドスタートの発生を防ぎ、少なくとも1つのインスタンスを常に稼働させることが可能。 - エンドポイントに紐づくコンポーネントごとに Auto Scaling ポリシーを設定できるため、モデルの負荷に応じた拡張性が確保されます。

アルゴリズム

SageMakerの組み込みアルゴリズムは、扱うデータの種類や解決したい課題に応じて、以下のようなカテゴリに分けられている。

| 表形式データ (Tabular) | 売上予測や顧客の解約予測など、表形式のデータを扱うためのアルゴリズム。 ・XGBoost:非常に人気があり、高い予測性能を持つ勾配ブースティングアルゴリズム。 ・Linear Learner:線形回帰やロジスティック回帰に使用される。入力された高次元ベクトル x とラベル y のペアから、線形関数または線形しきい値関数を学習し、x を y の近似値にマッピングする。クラス不均衡を取り扱う。・LightGBM:XGBoostと同様に勾配ブースティングの一種で、高速に動作するのが特徴。 ・Factorization Machines:クリック率予測や推薦システムに適している。 |

| テキスト (Text) | 自然言語処理(NLP)に関連するタスクのためのアルゴリズム群。 ・BlazingText:Word2Vec(単語のベクトル化)やテキスト分類を高速に実行する。 ・Sequence-to-Sequence:機械翻訳や文章の要約などに使われる。 ・Latent Dirichlet Allocation (LDA):文章のトピックを抽出するのに用いられる。 ・Object2Vec:テキストだけでなく、様々なオブジェクトをベクトル化できる汎用的なアルゴリズム。 |

| コンピュータビジョン (Vision) | 画像や動画を扱うためのアルゴリズム。 ・Image Classification::画像をカテゴリに分類する。 ・Object Detection:画像内の物体の位置と種類を特定する。 ・Semantic Segmentation:画像のピクセル単位で、それが何であるかを分類する。 |

| 時系列 (Time-series) | 株価や気象データなど、時間とともに変化するデータを予測するためのアルゴリズム。 ・DeepAR Forecasting:複数の関連する時系列データを用いて、精度の高い予測を行う。 |

| 教師なし (Unsupervised) | 正解ラベルがないデータから、パターンや構造を見つけ出すためのアルゴリズム。 ・K-Means:データをいくつかのクラスター(グループ)に分割する。 ・Random Cut Forest (RCF):データの中から異常な値(異常検知)を見つけ出す。 ・Principal Component Analysis (PCA):データの特徴を要約し、次元を削減するために使われる。 |

| オブジェクト検出アルゴリズム | 画像内に存在する複数の物体(オブジェクト)の「種類」と、その具体的な「位置(座標)」を特定するアルゴリズムです。検出された各オブジェクトは、その位置を示す四角い囲み(バウンディングボックス)で表示されます。 単一のディープニューラルネットワークを使用した教師あり学習アルゴリズムです。 SSD(Single Shot MultiBox Detector) というフレームワークを採用しています。 ベースネットワークとしてVGGとResNetをサポートしています。 ImageNetデータセットで事前トレーニングされたモデルを利用することも可能です。 |

※target_precision の詳細

主に binary_classifier に使用する。分類モデルが指定した精度(Precision)を達成するようにFalse Positive を減らす方向に予測しきい値を調整する。

注意点:指定値が必ず達成されるわけではなく、Recallとのトレードオフが発生する可能性あり

メトリクス / パラメータ

[メトリクス]

| メトリクス | CloudWatch Namespace | 主用途 | 適用対象 | 備考 |

| ModelSetup Time | AWS/ SageMaker | サーバーレス & バッチ推論でコンテナ起動〜ロード完了に要した合計時間を計測 | 単一モデル/サーバーレスエンドポイント | 値が高いと cold-start が原因のレイテンシー増加と判断できる |

| ModelLoading WaitTime | AWS/ SageMaker | Multi-Model Endpoint で、同一コンテナが別モデルをロードし終えるまでリクエストが待機した時間を計測 | MME(複数モデル同居) 専用 | サーバーレス単一モデルでは発生せず、起動遅延とは無関係 |

| Model Monitor 品質メトリクス | AWS/ SageMaker | 入力分布・予測結果の品質ドリフトやバイアスを検出 | エンドポイント全般 | レイテンシーではなくデータ品質の監視目的。起動時間は出力されない |

[パラメータ]

・EnableInterContainerTrafficEncryption

分散トレーニングにおけるノード間通信をTLSで保護できる。

リソース

| リソース | 目的 | 主な特徴 | 制限 |

| AWS::SageMaker::Model | Amazon SageMaker でホストされる機械学習モデルを定義。 | 推論用のモデルアーティファクトやコンテナイメージへのリンクを提供。 | エンドポイントやその編成を管理しない。 |

| AWS::SageMaker::Endpoint | 機械学習モデルをホストして予測を提供するエンドポイントを作成。 | デプロイされたモデルを使用して予測を呼び出すためのエントリーポイントを提供。 | 基盤となるモデルを作成または管理できない。 |

| AWS::SageMaker::NotebookInstance | モデルの構築とテスト用のインタラクティブな開発環境を提供。 | モデル構築や実験用の Jupyter Notebook をサポート。 | 本番環境のモデルホスティングや提供には適していない。 |

| AWS::SageMaker::Pipeline | データ準備、トレーニング、デプロイなどの機械学習ワークフローを自動化。 | 機械学習ワークフローの一連のステップを定義。 | 推論用のモデルを直接ホスティングまたは提供しない。 |

サービス連携

[セルフサービスで安全なデータサイエンス]

Service Catalog、SageMaker、Key Management Service (KMS) を連携させることで、データサイエンティストが煩雑な設定に触れずに、安全なセルフサービス環境で機械学習を活用する方法が紹介されている。

- 出力先の Amazon S3 バケット も KMS キーで暗号化し、モデルの成果物の安全性を確保。

- AWS Service Catalog を使って、あらかじめ設定された KMS キー付きの製品を提供し、ノートブックインスタンスのストレージを暗号化。

- セキュリティチームやインフラチームが事前に設定した製品で、統制のとれた環境を実現。

- SageMaker のノートブックやトレーニングジョブ作成時に、KMS キー ID を指定して暗号化を適用。

つまり、AWS の複数サービスを活用することで、コストとセキュリティの両立を図りながら、柔軟かつ安全にデータサイエンスを展開できるようにしている

[参照サイト]

◆派生サービス機能

[情報を展開する]

Autopilot

機械学習の専門知識がなくても、データセットから機械学習モデルの構築、トレーニング、デプロイのプロセスを自動化する機能(AutoML)。データの分析・前処理から、モデルの選択、ハイパーパラメータの最適化、デプロイまでを自動で実行。

[実行する主なタスク]

- データ分析と前処理

- モデルの選択

- ハイパーパラメータの最適化

- モデルのトレーニングと評価

- モデルのデプロイ

主な機能と利点

| ワークフローの自動化 | データの前処理、特徴量エンジニアリング、モデルのトレーニング、チューニングといった一連のプロセスを自動で実行 |

| 工数の削減 | ユーザーは最小限のコード作成で、高品質な予測モデルを迅速に得る |

| パフォーマンス評価 | モデルの性能を評価し、レポートとして提供するため、開発の手間を大幅に削減 |

サービス連携

| SageMaker JumpStart | 専門知識が不要: JumpStartで土台となるモデルを選び、Autopilotでトレーニングやチューニングを自動化するため、データサイエンスの深い知識がないユーザーでも高性能なモデルを構築できます。 効率化とコスト削減: コーディングを最小限に抑え、ワークフロー全体を自動化することで、効率的かつ効果的なソリューションを実現します。 |

Batch Transform

大量のデータに対して一括で推論(予測)を行うための機能。リアルタイムではなく、事前に用意したデータをまとめて処理するのに向いている。

[特徴]

| バッチ処理向け | リアルタイム推論ではなく、事前に用意したデータを一括で処理。 |

| 入力形式 | CSV、JSON Lines、または画像ファイルなど。 |

| 出力形式 | 予測結果を S3 に保存。 |

| スケーラブル | 複数のインスタンスで並列処理が可能。 |

Canvas

プログラミング(コーディング)なしで、クリック操作だけで機械学習の予測モデルを構築できるツール。顧客がサービスを解約する可能性(カスタマーチャーン)の予測在庫の計画や価格の最適化テキストや画像の分類文書からの情報抽出など。

Apache Parquet形式

データを列ごとに保存する列指向のストレージ形式であり、大量のデータを効率的に圧縮・処理するために設計された、高性能なファイル形式。

[なぜParquet形式のサポートが重要なのか]

ビジネスユーザーでも下記により大規模なデータを、より高速かつ効率的に扱って、精度の高い機械学習モデルを自分で作れるようになった。

- 分析に必要な列のデータだけをピンポイントで読み込めるため、無駄なデータの読み込みがなくなり、処理が非常に高速。

- データ処理時間を最小限に抑えられる。特に大量のデータを扱う場合、この高速化の恩恵は非常に大きく、モデルのトレーニングなどが素早く完了する。

機械学習モデルの利用

SageMaker Canvas のユーザーが機械学習モデルを利用するための前提条件と、そのモデルが必ず 「SageMaker Model Registry」に登録されている必要がある。

- Canvas を Model Registry と統合することで、モデルのバージョン管理やアクセス制御が可能になる。これにより、Canvas ユーザーに共有されるモデルが整理され、他の SageMaker サービスとの連携もスムーズになる。

- SageMakerの外部でトレーニングしたモデルでも、Model Registryに登録すればCanvasユーザーがインポートして予測に利用できる。

※外部で開発されたモデルを利用するには、モデルアーティファクトが保存されている S3 バケットへのアクセスが必要。このアクセス権限が設定されていない場合、Canvas ユーザーはモデルアクセスにアクセスできず、モデルのロードやチューニング操作を実行できない。S3バケットのアクセス制限を設定する際は s3:Getobject 権限を含む適切なIAMポリシーを設定する必要がある。

Clarify

機械学習モデルの入力データおよび推論結果に潜むバイアスや精度低下の原因となるデータ内の傾向を評価・特定。これにより、ユーザー層毎の予測パフォーマンスのばらつきや不公平な結果の原因を分析し、改善するための具体的な洞察を得ることができる。

分析機能

機械学習モデルに対して以下の2つの観点から分析を行う。

| バイアス検出 (Bias Detection) | ・データセットやモデルに潜在するバイアス(性別・年齢・人種など)を検出 ・公平性の観点からモデルの健全性を評価 |

| 説明可能性(Explainability) | ・モデルの予測に対して、どの特徴量がどのように影響したか可視化 ・SHAP値(SHapley Additive exPlanations)を用いた詳細な分析 |

主な機能とオプション

| 機能カテゴリ | 機能名 | 説明 |

| バイアス分析 | Pre-training bias | 学習前のデータセットに潜むバイアスを検出 |

| Post-training bias | 学習後のモデル出力に潜むバイアスを検出 | |

| 説明可能分析 | SHAP値分析 | 各特徴量が予測に与えた影響を定量化 |

| グローバルSHAP | 全体的な特徴量の重要度を表示 | |

| ローカルSHAP | 個別予測に対する特徴量の影響を表示 | |

| レポート出力 | Bias Report | バイアスの統計と可視化 |

| Explainability Report | SHAP値に基づく特徴量の影響レポート | |

| 統合機能 | SageMaker Studio | GUIベースでClarifyジョブを作成・実行 |

| SageMaker Pipelines | MLOpsパイプラインに組み込み可能 |

Data Wrangler

機械学習(ML)で使うためのデータの準備から異常検出、特徴量エンジニアリングまでの一連のデータ準備プロセスを効率化し、迅速かつ正確に実行できるようになる。また結果の可視化を単一のツールで効率的に実行。特に、データの不均衡や特徴量間の相互依存性といった問題に、「組み込みの異常検出機能」や「可視化機能」を用いて迅速に対応。

主な機能

| データの統合(Import) | 複数の異なる場所にあるデータをインポートし、1つのデータフレームにまとめることができます。S3, Athena, Redshift, Snowflake, Databricksなど、多様なデータソースに接続してデータをインポートできます。 |

| データクレンジング | データの「お掃除」機能です。欠けている値の補充、重複データの削除、極端におかしい値(外れ値)の処理などができます。 |

| エンリッチメント(データ加工)変換 (Transform) | 既存のデータをもとに、新しいデータ項目(変数)を追加したり、データを変換したりできます。テキストや日付の処理、欠損値の埋め込み、カテゴリ別エンコーディングなど、300以上の組み込み変換機能を使用してデータセットをクリーンアップし、特徴量を作成できます。 |

| 簡単な操作とカスタマイズ性 | たくさんの「組み込みの変換機能」が用意されており、コーディングなしで直感的に操作できます。 さらに高度な処理が必要な場合は、PySparkやPython、pandasなどを使って独自のカスタム変換を追加することも可能です。 |

| 効率的な処理 データフロー (Data Flow) | 一度の操作で複数の列をまとめて削除するなど、効率的に作業を進められます。 ただし、「数値の処理」や「欠損値の処理」のように、1つの列に対してのみ適用できる機能もあります。GUIを使用して、さまざまなデータソースの結合や、データセットに適用する変換の定義など、一連のデータ準備手順(MLパイプライン)を構築できます。 |

| データインサイトの生成 (Generate Data Insights) | 「データ品質とインサイトレポート」により、データ品質を自動的に検証し、異常を検出します。 |

| 分析 (Analyze) | 散布図やヒストグラムなどの可視化ツールや、ターゲット漏洩分析などの機能を用いて、データ内の特徴や相関性を理解できます。 |

| エクスポート (Export) | 準備が完了したデータワークフローを、Amazon S3バケット、Amazon SageMaker Pipelines、Amazon SageMaker Feature Store、またはPythonスクリプトとしてエクスポートできます。 |

バランスデータ

データの不均衡を解決するための操作。少数派クラスをオーバーサンプリング(過剰に抽出)して、クラスの分布を均一にすることができます。GUIベースで直感的に操作できるため、高品質なデータを迅速に準備できます。

また、様々なデータソース(Amazon S3やオンプレミスのMySQLなど)と簡単に統合でき、トレーニング全体のパイプラインを一元管理できるため、エンジニアはモデルのトレーニングに集中できます。

| ランダムオーバーサンプリング | 少数カテゴリのサンプルをランダムに複製します。例えば、不正検出のケースで不正ケースが全体の10%しかない場合、このデータを8回複製して不均衡を是正します。 |

| ランダムアンダーサンプリング | 多数派カテゴリからサンプルをランダムに削除し、目的のサンプル割合を取得します。 |

| Synthetic Minority Oversampling Technique (SMOTE) | 過小評価されているカテゴリのサンプルを使用して、新しい合成マイノリティ(少数派)サンプルを補間します。 |

カテゴリ別エンコーディング

| ワンホットエンコーディング | 各カテゴリ値を「0」または「1」のバイナリ形式で表現します。例えば、「A」「B」「C」はそれぞれ [1,0,0] [0,1,0] [0,0,1] のように変換されます。 |

| ターゲットエンコーディング | カテゴリ変数を、目的変数の統計値(平均値など)に基づいて数値に変換します。カテゴリが多い場合や、カテゴリ間に順序性がある場合に有効です。 |

| ラベルエンコーディング | 各カテゴリに整数を割り当てます(例:A=1, B=2, C=3)。順序を持つカテゴリデータに適しています。 |

オプション

[基本的なデータ変換オプション]

| オプション名 | 説明 |

|---|---|

| FirstK | 指定した行数のデータを抽出(サンプリング) |

| Split | データを訓練・検証・テスト用に分割(ランダム・順序・層化) |

| Join | 複数のデータセットを結合(Inner, Left, Right, Full Outer) |

| Filter | 条件に基づいてデータを絞り込み(数値・文字列・日付・複合条件) |

| Drop Column | 不要なカラムを削除 |

| Rename Column | カラム名の変更 |

| Change Data Type | データ型の変換(文字列→数値など) |

| Corrupt image(ノイズ付与) | 画像データ(JPEG、PNGなど)に対して、破損や読み込みエラーを検出・修復するための前処理 |

| Impulse Noise | SageMaker Data Wrangler における「Impulse Noise」は、画像データの前処理ステップの一つで、突発的な画素異常(塩胡椒ノイズなど)を検出・除去する |

[特徴量エンジニアリングオプション]

| カテゴリ | オプション | 用途 |

|---|---|---|

| カテゴリ変数 | One-hot encoding, Label encoding | カテゴリ変数の数値化 |

| 数値変換 | Min-max scaling, Z-score normalization | 正規化処理 |

| テキスト処理 | TF-IDF, Word embeddings | テキストの特徴量化 |

| 時系列処理 | ラグ特徴量、日付分解 | 時系列データの抽出 |

| 欠損値処理 | 平均値補完、前方補完 | 欠損値の補完 |

[分析・可視化オプション]

| オプション名 | 説明 |

|---|---|

| Data Quality & Insights Report | 欠損値・外れ値・ターゲットリークの検出 |

| Quick Model | 簡易モデルによる予測力の確認 |

| Feature Summary | 各特徴量の予測力スコア表示 |

| ターゲット漏洩解析 | モデルに悪影響を与える特徴量の検出 |

[エクスポートオプション]

| エクスポート先 | 説明 |

|---|---|

| Amazon S3 | 変換済みデータの保存 |

| SageMaker Pipelines | モデル学習パイプラインへの統合 |

| Feature Store | 特徴量の一元管理 |

| Python Script | カスタムワークフロー用コード出力 |

Debugger

機械学習モデルのトレーニング中に発生する問題を自動で検知し、モデルの内部状態を可視化できるツール。必要に応じて、カスタムルールを定義してより細かい検証も可能。精度が上がらない原因調査やモデルの挙動をリアルタイムで監視したいときに有効

[対応フレームワーク]

TensorFlow , PyTorch , MXNet , XGBoost など

機能性

| モデル内部の 状態を記録 | 重み、勾配、各レイヤーの出力、lossなどをS3に保存できる。 |

| 自動問題検知 | 「勾配消失」や「lossが減らない」など、事前定義されたルール(またはカスタムルール)に基づいて問題を検出する。 |

| TensorBoard 連携 | TensorFlow以外のフレームワーク(PyTorchなど)でも、TensorBoard形式でログを出力して可視化できる。 |

| スクリプトの 変更不要 | SageMakerの対応コンテナを使えば、トレーニングスクリプトを変更せずにDebuggerを有効化できる。 |

●Tensor Board

TensorFlowに付属する可視化ツールで、以下のような情報をグラフィカルに表示できる。

・GPU/CPUの使用状況

・損失関数や精度などのスカラー値の推移

・特徴マップや畳み込みカーネルなどの画像データ

・各層の重み・バイアスのヒストグラム

・モデルの計算グラフ(順伝播・逆伝播の流れ)

・埋め込みベクトルの分布(例:Word2Vec)

・ハイパーパラメータの探索結果

Experiments

複数のハイパーパラメータやアルゴリズムを試す反復的なML開発プロセスに対して、MLモデルのトレーニングや評価における実験の記録・整理・比較を支援する。

[主な機能]

| エクスペリメントの作成 | プロジェクト単位で実験をグループ化。 |

| トライアルとトライアルコンポーネント | 各トレーニングジョブや評価ステップを個別に記録。 |

| 自動トラッキング | 入力データ、パラメータ、結果などを自動で記録。 |

| 可視化と比較 | SageMaker Studioで実験結果をグラフ表示し、パフォーマンスを比較。 |

| 再現性の確保 | 過去の実験履歴を保存し、モデルの再現性を担保。 |

Future Store

機械学習モデルのための特徴量を一元管理するためのフルマネージドサービス。特徴量(Feature)とは、MLモデルに入力する意味のあるデータのこと。Feature Storeはそれらを保存・共有・管理するための専用リポジトリ。

主な機能

| 特徴量グループの作成 | 特徴量を論理的にまとめた「Feature Group」を定義し、スキーマに基づいて管理。 |

| オンラインストア | リアルタイム予測向け。最新の特徴量を高速に取得可能。 |

| オフラインストア | バッチ学習や分析向け。履歴データを保持。 |

| Point-in-time Join | 特定の時点における特徴量を正確に結合する機能。学習と推論の整合性を保つのに重要。 |

| 特徴量の再利用と共有 | チームやプロジェクト間で特徴量を再利用できるため、重複作業を削減。 |

| トレーニング・推論のスキュー防止 | 学習時と推論時で異なる特徴量が使われることによる精度低下を防ぐ。 |

Future Group

機械学習モデルに使う特徴量を論理的にまとめたデータの集合体。特徴量グループは、MLモデルのトレーニングや推論に使う特徴量(Feature)をまとめたもの。1つのグループは、共通のスキーマ(列名とデータ型)を持つレコードの集合。Feature Storeに保存する際の基本単位であり、特徴量の作成・取得・共有・管理を行うための枠組み。

[構成要素]

| 特徴量定義 | 各特徴量の名前とデータ型(整数、文字列、浮動小数点など)を指定。 |

| イベントタイム | 各レコードに関連づけられる時刻情報。Point-in-time Joinなどで重要。 |

| ストレージタイプ | ・オンラインストア:リアルタイム推論向け。最新の特徴量を高速取得。 ・オフラインストア:バッチ学習や分析向け。履歴データを保存。 |

Ground Truth

ラベル付きデータセットを作成できる機械学習とともに、Amazon Mechanical Turk、任意のベンダー会社、または社内のプライベートワークフォースのいずれかのワーカーを使用できる。Ground Truth のラベル付きデータセット出力を使用して、独自のモデルをトレーニングできる。Amazon SageMaker AI モデルのトレーニングデータセットとして出力を使用することもできる。

ヒューマンインザループ(HITL)のラベリングタスクを支援するために設計されている。

JumpStart

様々な問題に対応できる、学習済みのオープンソースモデル。ユーザーはこれを基盤として、機械学習をすぐに始めることができる。デプロイ、微調整、評価までを一貫して行えるハブのような機能。これにより、ローコード・ノーコードの手法を容易に採用できる。

●事前トレーニング済のモデル

機械学習を容易に始めるための、幅広い問題に対応する「事前トレーニング済みのオープンソースモデル」を提供する。更新された「Studio エクスペリエンス」のJumpStartランディングページを通じて、一般的なモデルハブからこれらのモデルをデプロイ、微調整、評価することができる。

・提供されるモデルは、デプロイ前にトレーニングや調整(チューニング)が可能。

・一般的なユースケースのインフラをセットアップするための「ソリューションテンプレート」も提供される。

・SageMaker MLを使用した機械学習用の「実行可能なサンプルノートブック」も含まれる。

連携サービス

[Autopilotとの連携]

Autopilotと併用することで、モデルのトレーニングやチューニングが自動化され、データサイエンスや機械学習の専門知識がなくても高性能なモデルを構築することが可能

Market Place

機械学習モデルやアルゴリズムを簡単に導入・利用できるAWSのプラットフォーム。

| 事前構築済みのMLモデルや アルゴリズムを提供 | 開発者や企業は、すぐに使えるモデルやアルゴリズムを選んで導入できる。 |

| AWS Marketplaceと統合 | セキュリティ、ネットワーク、ストレージ、データベースなど、他のカテゴリのソフトウェアと同様に、ML関連の製品も一元管理できる。 |

| 柔軟なライセンスと価格設定 | サブスクリプション型や従量課金型など、用途に応じた価格体系が選べる。 |

| 簡単なデプロイと管理 | SageMaker Studioなどの環境から、数クリックでモデルをデプロイ可能。 |

| サードパーティ製品も多数掲載 | Hugging Face、DataRobot、Algorithmiaなど、外部ベンダーの製品も利用できる。 |

Model Registry

作成した様々なバージョンの機械学習モデルを、一元的なリポジトリ(保管場所)で整理・追跡・管理するためのサービス。モデルの登録、バージョンの管理、承認やデプロイといったMLモデルのライフサイクル全体を管理する中心的なハブ。AWS内外を問わずモデルの運用が非常に効率的になる。

主な機能

| 組織全体の標準化とセキュリティ向上 (プライベートリポジトリ) | ・モデル管理のカタログ(場所)一元化 「クロスアカウントリソースポリシー」機能を使うことで、組織内に新しいAWSアカウントが増えても保存場所を1つに統一できる。モデルの異なるバージョンを一貫して管理できる。 これまでは主にAWS内のサービス(ECR)に保存されたモデルが、AWS以外のプライベートなDockerリポジトリ(例: 企業内のサーバーなど)に保存されているMLモデルも登録・追跡できるようになった。 ・トレーニングデータ連携 S3に保存されたトレーニングデータと連携し、モデルの再トレーニングなどを行う際にセキュアなデータアクセスを保証する。 |

| 他のユーザーとのモデル共有 | 開発したMLモデルをこのサービスに登録することで、誰がいつどんなモデルを作ったのかを一覧で管理できる。複数のAWSアカウント間でモデル情報を効率的かつ安全に共有できる。 |

| メタデータの関連付け | SageMaker Studioと統合されており、UI上でモデルの状態やメタデータ(付随情報)を簡単に追跡できる。 |

基本的な構成

| Model Group | 「Model Group」という単位で関連するモデル(モデルパッケージ)を論理的に整理し、運用効率を向上 |

| モデル パッケージ | 個々のトレーニング済みモデルのこと。 |

| モデル バージョン | Model Groupに新しいモデルパッケージが追加されるたびに、「1, 2, 3…」と自動で割り振られるバージョン番号。 |

Model Monitor

機械学習モデルの予測精度やバイアス、入力データの品質が時間とともに劣化する「ドリフト」を検出するアラートを設定できる。モデルの再トレーニング、アップストリームシステムの監査、品質問題の修正などのアクションを実行できる。コーディングが不要な Model Monitor のビルド済みモニタリング機能を使用可能。

モニタリング機能

[主な機能]

| データ品質モニタリング | 入力データの分布や欠損値などの変化を検出 |

| モデル品質モニタリング | 精度や予測分布の変化を検出 |

| バイアスドリフト検出 | モデルの予測に偏りが生じていないかを監視 |

| Feature Attribution ドリフト | 特徴量の重要度が変化していないかを監視 |

[モニタリングの仕組み]

| データキャプチャ | 推論リクエストの入力と出力を S3 に保存。 |

| ベースライン作成 | トレーニングデータから統計情報と制約条件(constraints.json)を生成。 |

| 監視ジョブの設定 | スケジュールに従ってリアルタイムまたはバッチで監視。 |

| 異常検出と通知 | CloudWatch 経由で違反を検出し、アラートを発報。 |

ベースライン

モデルが常に最新のデータに適応し、適切な品質を維持するためには、定期的にデータから新しい「ベースライン」を作成し、評価の基準を最新に保つことが重要である。

データ品質の基準となるもので、データの統計情報やスキーマ(構造)を定義する。SageMaker Model Monitorは、このベースラインとリアルタイムデータを比較することで、データの異常やドリフト(時間経過によるデータの傾向の変化)を検出する。

| 新しいベースラインが必要な時 | モデルを更新した際など、新しいデータ分布が発生して既存のベースラインが現状と合わなくなった場合に、新しいベースラインを作成する必要がある。最新の本番データ(トレーニングデータ)を使って、統計情報とスキーマを抽出し、新しいベースラインを生成する。生成したベースラインをModel Monitorに設定し、今後のデータ品質の評価基準として使用していく。 |

| ベースライン作成の自動化 | Model Monitorには、CSVやJSON形式のデータから、データのドリフトなどを検出するためのベースラインを自動的に提案・作成する機能が組み込まれている。 |

ML Lineage Tracking

データ準備からモデルデプロイまで、MLワークフローの各ステップの情報を詳細に記録・追跡(トラッキング)する機能。モデルが「いつ、どのデータで、どのように作られたか」という系統(リネージ)を追跡できるため、監査やコンプライアンス確認に必要な「ガバナンス機能」を提供する。

Pipelines

データ準備、トレーニング、評価、モデルデプロイといった一連のMLワークフロー全体をエンドツーエンドで自動化するためのサービス。機械学習のワークフローを有向非巡回グラフ(DAG)として可視化・管理する機能。これにより、データサイエンティストはワークフロー全体を細かく制御できる。15TBを超えるような大規模データセットも効率的に処理できる。

コールバックステップ

ML の CI/CD パイプライン内で、外部のタスクやジョブをステップとして統合可能になった。コールバックステップが呼ばれるとタスクが開始され、外部からタスク完了を通知する仕組み(タスクトークン)が使える。コールバックステップは Glue ワークフローを起動し、進行状況を EventBridge 経由で監視。Glue ジョブが完了するまでパイプラインは停止し、完了後に次の処理へ進む。これにより、Glue ジョブの出力を効率的にモデル開発のデータ処理フェーズに利用できる。

例:Amazon EMR の Spark ジョブや AWS Glue の ETL ジョブをパイプラインの一部として実行できる。

サービス連携

〇EventBridgeとの連携

MLパイプラインの開始や監視を自動化し、プロセス全体を効率的かつエラーの少ない方法で運用できる。EventBridgeを利用して、SageMaker Pipelinesの実行をスケジュールしたり、特定のイベントをきっかけに自動で開始(トリガー)したりすることが可能。

Serverless Inference

サーバー管理不要でAWSがMLモデルのインフラ管理やスケーリングを自動で行う便利なサービス。「プロビジョニングされた同時実行」を設定すれば、アクセスが集中する時間を予測して事前準備を行い、遅延なく安定したパフォーマンスをコスト効率よく提供できる。あらかじめ指定した数の推論環境を「ウォームアップ」(事前準備・待機)させておくことで、コールドスタートを解消し、予測されるトラフィックに対して高いパフォーマンスとスケーラビリティを確保する。

※断続的な推論リクエストには向いている。常に高い負荷がかかるため起動の遅延が生じやすい。

Inference Recommender

機械学習モデルの推論に最適なインスタンスタイプや構成を自動で提案する機能。

主な特徴

| 最適なインスタンス選定を自動化 | 従来は複数のエンドポイントを手動でテストする必要がありましたが、Inference Recommender により モデルに最適なインスタンスや構成(数、メモリ、同時実行数など)を自動で評価・提案 できる。 |

| リアルタイム/サーバーレス推論に対応 | 推論エンドポイントのタイプ(リアルタイム or サーバーレス)に応じて、最適な設定を選定可能 |

| ベンチマークジョブによる性能評価 | SageMaker Studio や AWS SDK for Python(Boto3)を使って、推論負荷テストを実行し、パフォーマンスとリソース使用率のメトリクスを収集する。 |

| コスト効率の向上 | 過剰なリソースを避け、必要最小限の構成で高パフォーマンスを実現 できるため、運用コストの削減に貢献。 |

ジョブタイプ

| Default ジョブタイプ | 目的:モデルに対して基本的なベンチマークを実行し、最適なインスタンスタイプを提案 入力:モデルパッケージの ARN を指定するだけで開始可能 テスト内容:SageMaker が用意した標準的なトラフィックパターンでロードテストを実施 所要時間:通常 45 分以内で完了 特徴:簡単に始められる、サーバーレス推論にも対応、高速な初期評価に最適 |

| Advanced ジョブタイプ | 目的:本番環境に近い条件で詳細なパフォーマンス評価を実施 入力:インスタンスタイプやサーバーレス設定、カスタムトラフィックパターン、レイテンシー・スループット要件などを指定 テスト内容:指定した条件に基づくカスタムロードテスト 所要時間:平均 2 時間程度(ジョブ設定とテスト数により変動) 特徴:より精密な評価が可能、本番運用に向けた構成検討に最適、オートスケーリングポリシーの初期設定にも活用可能 |

Studio Classic

2023年11月以降、従来の SageMaker Studio は「Studio Classic」と呼ばれ、新しい SageMaker Studio はより高速で統合されたUIを提供している。

●SageMaker Studio(新しいStudio)

AWSが提供する最新の機械学習統合開発環境。VS CodeベースのIDEやJupyterLab、RStudioを選べる柔軟なUIを備え、数秒で起動可能。Amazon Q Developer によるAI支援やGit連携、S3・RedshiftなどのAWSサービスとの統合もスムーズで、MLOpsやチーム開発に最適。

●SageMaker Studio Classic(従来型Studio)

JupyterLabベースのIDEで、データ準備からモデル構築・トレーニング・デプロイまでを一貫して行える。起動に時間がかかることがあり、Git連携やAWSサービスとの統合は手動設定が中心。個人開発や研究用途に向いている。

※AWSが提供する機械学習向けの統合開発環境(IDE)

| Studio | Classic | |

|---|---|---|

| 概要 | ||

| IDE選択 | 複数(VS Code, JupyterLab, RStudio) | JupyterLabのみ |

| 起動速度 | 高速(数秒) | 遅め(数分) |

| AI支援 | あり(Amazon Q) | なし |

| Git連携 | UI統合 | 手動設定 |

| 拡張性 | VS Code拡張対応 | 限定的 |

| 推奨用途 | チーム開発・MLOps | 個人開発・研究 |

Bedrock

AWS が提供する フルマネージド型の生成AIサービス。大規模言語モデル(LLM)や生成AIモデルを インフラ管理不要 で利用できる。ユーザーはモデルを自分で構築したり学習したりする必要がなく、AWS 上で提供されている複数のモデルプロバイダー(Anthropic、Meta、Mistral、Amazon Titan など)のモデルを API 経由で呼び出して使える。主に自然言語処理やテキスト生成などの用途に使用される。

●Jurassic-2 models

サポートされている言語。英語での最高品質のパフォーマンスに加えて、全ての J2 モデルは、次のようないくつかの英語以外の言語をサポートしている。

対象:スペイン、フランス、ドイツ、ポルトガル、イタリア、オランダ

●ナレッジベース

・検索拡張生成(RAG)を簡単に実装可能。

・構造化・非構造化データの両方に対応(例:S3、Salesforce、SharePointなど)。

・自然言語→SQL変換(NL2SQL)により、構造化データから直接情報取得。

・引用付き応答で、元データの出典を明示。

主な機能

| 複数のモデルが選べる | Anthropic Claude AI21 Labs Jurassic-2 Stability AI (画像生成) Meta Llama 2 / 3 Mistral Amazon Titan など → 1つの API で様々なモデルを比較・利用可能。 |

| 学習やインフラ管理が不要 | サーバー構築、GPU管理、モデル学習を自分で行う必要がなく、即利用できる。 |

| カスタマイズが可能 | ・プロンプト調整 ・ファインチューニング(微調整) ・RAG (Retrieval-Augmented Generation) 構成で独自データと組み合わせて回答を生成できる。 |

| AWS サービスとの連携 | ・Amazon S3(データ格納) ・Amazon Kendra(検索ベースのRAG) ・Amazon SageMaker(カスタムMLとの統合) |

| セキュリティとガバナンス | ・データはモデルプロバイダーに直接渡らず、AWS 内で安全に処理。 ・コンプライアンスや監査対応が必要な企業向けにも利用しやすい。 |

| ユースケース | ・チャットボット / カスタマーサポート ・ドキュメント要約 / 検索支援 ・コード生成 / アプリ開発支援 ・画像生成 / クリエイティブ制作 ・社内ナレッジ検索 (RAG構築) |

| メリット | ・モデル開発不要で即利用できる。データ取り込み、検索、プロンプト拡張までを一括管理。 ・複数のモデルを使い分けられる ・AWS セキュリティ基盤を活用可能 ・ベクトル検索とエンベディングにより、意味的に関連する情報を抽出。 ・セキュアな接続:基盤モデルやエージェントが安全にデータソースへアクセス。 |

| デメリット | ・モデルの「中身」を自由に改造はできない ・利用料金はAPI従量課金 → 大規模利用でコスト増 ・最先端のオープンモデルを自分で細かくチューニングしたい場合は制限あり |

[応答生成を制御する主要パラメータ比較表]

・温度 → 「確率の高低どちらを取りやすいか」を調整

・top_k → 「候補数の幅」を調整。生成する応答のランダム性を制御する。

・top_p → 「確率分布の上位何%までを候補にするか」を調整

| パラメータ | 説明 | 値を小さくした場合 | 値を大きくした場合 | 簡単な例 |

|---|---|---|---|---|

| 温度(temperature) | 出力確率分布の「滑らかさ」を調整。応答のランダム性を制御。 | 決定論的になり、一貫性が高まる。 確率の高い定番の応答を選びやすい。 | ランダム性が増し、多様な応答が得られる。 確率の低い答えも選ばれやすい。 | 「好きな動物は?」 – 低い温度 → 「犬」 – 高い温度 → 「犬」「猫」「キリン」など |

| トップK (top_k) | 次のトークンを選ぶ際に考慮する候補数を制限。 | 候補が少なくなり、安定・一貫した応答になりやすい。 | 候補が広がり、多様で予想外の応答も出やすい。 | 「朝ごはんは?」 – 低い top_k → 「パン」だけ – 高い top_k → 「パン」「ごはん」「おにぎり」など |

| トップP (top_p) (核サンプリング) | 確率分布の上位から「合計確率pまで」の候補だけを考慮。 | 上位候補だけに限定され、予測可能性が増す。 安定した応答になりやすい。 | 確率の低い選択肢も残りやすくなり、ランダム性と多様性が増す。 | 「好きな果物は?」 – 低い top_p → 「リンゴ」 – 高い top_p → 「リンゴ」「バナナ」「ドラゴンフルーツ」など |

Polly

音声発話サービス。文章をリアルな音声に変換するサービス。発話できるアプリケーションを作成できる。

Textract

紙の書類やPDF、画像からテキスト・表・フォーム情報を抽出。

主な機能

| OCR(光学文字認識) | 文字を認識して抽出 |

| 表認識 | 表の構造を理解し、セルごとにデータを抽出 |

| フォーム認識 | ラベルと値のペア(例:氏名:山田太郎)を抽出 |

| 署名検出 | 手書き署名の有無を検出(一部リージョンで対応) |

[使用例]

| 入力形式 | 出力内容 | 利用例 |

|---|---|---|

| スキャンした請求書 | 金額、日付、会社名などの抽出 | 経理システムへの自動入力 |

| 手書きの申込書 | 名前、住所、電話番号などの抽出 | 顧客情報のデジタル化 |

| PDFの契約書 | 契約条件、署名欄の検出 | 契約管理システムへの登録 |

Transcribe

音声を自動的にテキストに変換する。リアルタイムまたは録音済みの音声を高精度で文字起こしできる。100以上の言語と方言に対応しており、日本語もサポートされている。

使い方も比較的シンプルで、音声ファイルをS3にアップロードし、Transcribeでジョブを作成するだけでテキスト化できる。

・話者の識別(話者ダイアライゼーション)や自動句読点の挿入、カスタム語彙の登録など、実用的な機能が豊富。

・字幕ファイルの生成や医療分野向けのTranscribe Medicalも利用可能。

・コールセンターの通話分析や会議の議事録作成、動画の字幕生成など、幅広いユースケースに活用されている。

Translate

AWSが提供するニューラル機械翻訳サービスで、テキストを高精度かつ高速に翻訳するクラウドベースのツール

主な特徴

| ニューラル機械翻訳(NMT) | 深層学習技術を活用し、文脈を理解した自然な翻訳を実現 |

| リアルタイム & バッチ翻訳 | API を使って即時翻訳も、大量のテキストを一括翻訳することも可能 |

| カスタマイズ可能 | 特定のブランド名や業界用語などを定義して、翻訳結果を調整可能 |

| 多言語対応 | 英語、日本語、中国語、スペイン語など、数十の言語間で翻訳可能 |

ユースケース

| ユーザー生成 コンテンツの翻訳 | SNS投稿、コメント、プロフィールなどをリアルタイムで翻訳 |

| 多言語チャット対応 | カスタマーサポートや社内チャットで言語の壁を解消 |

| ドキュメント翻訳 | Word、Excel、PowerPoint などのファイルを一括翻訳 |

| NLP連携 | Comprehend と組み合わせて感情分析やキーフレーズ抽出も可能 |

Comprehend

自然言語処理(NLP)サービスで、機械学習を活用してテキストデータを分析し、チャットデータから顧客の感情(ポジティブ、ネガティブなど)を抽出するなど、価値ある情報を効率的に引き出す。既存のデータをインプットするだけで、迅速に分析結果を得られるため、誰でも簡単に大量のテキストデータから洞察を得ることができる(2026 年 5 月 20 日サポート終了)

・利点として、ユーザー自身が機械学習(ML)モデルのトレーニングやチューニングを行うなど、複雑で手間のかかる作業を省略できる。

・PII(保護対象医療情報)を検出し、マスクまたは除去する機能を備えている。英語またはスペイン語のテキストドキュメントでPII エンティティを検出できる。PIIエンティティは特定の種類の個人を特定できる情報(PII)。PII検出機能を使用して、PIIエンティティを検索したり、テキスト内のPIIエンティティを編集したりする。

主な機能

| 機能 | 説明 |

| エンティティ認識 | テキストから特定のエンティティ(例:人名、組織名、場所、日付、数詞、電話番号など)を自動抽出。 |

| 感情分析 | テキストの感情を識別し、ポジティブ、ネガティブ、ニュートラル、ミックスのいずれかに分類。 |

| キーフレーズ抽出 | テキスト全体からその文脈や内容において最も重要な単語やフレーズを抽出する機能。たとえば、ニュース記事から「新技術」「市場動向」などの主要な話題やテーマを自動的に特定できる。 |

| 言語検出 | テキストが書かれている言語を自動で識別します(最大 100 種類以上の言語に対応)。 |

| トピックモデリング | 大量の文書データを分析し、隠れたトピックやテーマを自動的に抽出。 |

| カスタム分類 | ユーザーが定義したラベル(例:「重要」「非重要」など)を基にテキストを分類。 |

| カスタムエンティティ認識 | 独自のエンティティ(例:商品コード、特定の業界用語など)をトレーニングして識別する機能。たとえば、契約書内の「クライアント名」や「契約日」のような特定のエンティティを定義してトレーニングすることで、独自のビジネスルールに基づいた情報抽出が可能。 |

| 構文解析 | テキストを文法的に解析し、単語の品詞(名詞、動詞、形容詞など)や構文構造を特定。 |

| イベント抽出 | 特定の条件や構造に基づいて、テキスト内の出来事やアクションを抽出。 |

ジョブ

| DetectPiiEntities | テキスト内の個人を特定できる情報(PII)をリアルタイムで検出。 |

| StartPiiEntitiesDetectionJob | 複数の文書を一括で処理する非同期ジョブを開始し、PIIを検出・編集 |

| RedactionConfig | PIIをどのように編集(秘匿)するかを設定 |

Import Model

インポートすると、コピー元のモデルと全く同じ、トレーニング済みの複製モデル(Comprehendのカスタムモデル)が新しいアカウントに作成(コピー)される。

| 必要な設定 | コピー元のAWSアカウントで、コピー先のアカウントからのインポートを許可するためのIAMポリシーを設定する必要がある。 |

| 重要な制約 | インポート元とインポート先のモデルは、必ず同じAWSリージョンに存在している必要がある。異なるリージョンをまたいでのインポートはできない。 |

| 利点 | この方法はComprehendの組み込み機能を使うため、追加のインフラ構築やデータ転送が不要で、最小限の開発作業で実現できる。 |

Medical

AWSが提供する自然言語処理(NLP)サービスで、医療分野向けに特化したツール。

[主な機能]

- 非構造化医療テキストの解析

医師のメモ、退院サマリー、検査結果などから、病名・薬剤・治療法・PHI(保護医療情報)などの医療関連エンティティを自動抽出します。 - 信頼スコアの提供

抽出された情報には、モデルがどれだけ自信を持っているかを示す「信頼スコア」が付与されます。 - オントロジーとのリンク

抽出したエンティティを標準化された医療用語体系(オントロジー)に結びつけることで、より高度な分析が可能です。 - 同期・非同期処理に対応

単一文書の即時解析(同期)と、S3に保存された複数文書のバッチ解析(非同期)の両方に対応しています。

Rekognition

動画や画像認識。イメージや保存済みのビデオから有名人を認識できる。

Lambda関数を使用するとスケーラブルでコスト効率の高いアプリケーション層が得られる。イメージ内の有名人を認識し、認識した有名人に関する追加情報(時間など)を取得するには非ストレージ型のAPIオペレーション「RekognizeCelebrities」を使用する。Rekognition APIにイメージや動画を指定すると、モノ、人物、テキスト、シーン、アクティビティを識別。

Kendra

AIを活用して、「自然言語検索」や「セマンティック検索(文脈や意味を理解した検索)」を実現する。AWSのフルマネージドサービスなので、運用管理の手間が少なく、拡張性にも優れている。質問に対してインテリジェントな回答を生成できるため、検索拡張生成(RAG)アプリケーションの構築に最適。

データソースコネクタ

Kendraは「データソースコネクタ」という機能を使って、様々なデータソースに接続し、検索対象のインデックス(索引)を作成する。接続先として、Amazon S3の他に、Microsoft SharePointやGoogle Driveなどが挙げられている。

このコネクタは、データソースを定期的にスキャンし、ドキュメントの変更や追加を自動でインデックスに反映させるため、常に最新の状態で検索ができる。

[S3 との連携]

「Amazon S3 コネクタ」を使うことで、S3バケットに保存されているテキストファイルなどを直接インデックス化し、高精度なセマンティック検索を簡単に実現できる。S3などの多様なデータソースに接続するだけで、AIによる高精度な意味検索を簡単に構築できるサービス。インデックスを自動で最新に保ってくれるため、RAGのような高度なアプリケーションにも適している。

Glue Data Brew

ノーコードでデータのクレンジング(前処理)(データのクリーニング・整形・変換)を行えるGUIベースのETLツール。分析、レポート、機械学習などの後続タスクのために、クリーンで安全なデータセットを簡単に準備することができる。

[Data Wrangler との違い]

・Data Wrangler:コードで柔軟にデータ処理したい人向け

・Glue DataBrew:ノーコードで視覚的にデータ整形したい人向け

| 項目 | Data Wrangler | Glue Data Brew |

|---|---|---|

| 操作方法 | Pythonコード(pandas) | GUI(ノーコード) |

| 対象ユーザー | エンジニア、分析者 | 非エンジニア、アナリスト |

| 柔軟性 | 高(自由なロジック記述) | 中(組み込み変換に依存) |

| 学習コスト | Python知識が必要 | 直感的で学習コスト低め |

| 処理対象 | S3, Redshift, Athenaなど | S3, Redshift, RDSなど |

| 主な用途 | ETL自動化、分析前処理 | データ整形、品質評価 |

特徴と構成

[主な特徴]

| データ品質のプロファイリング | データ内の欠損値や異常値の検出、統計情報の可視化を簡単にできる。 |

| プライバシー保護 | 機密データを安全にマスク(隠す)処理ができるため、プライバシー要件を満たしながら、機械学習モデルの準備などにデータを利用できる。 |

| 多様な変換処理 | 250以上の変換処理(欠損値処理、正規化、型変換、フィルタリングなど)を用意。 |

| 検出マスキング | ・検出:2、3回クリックするだけで、データ内のPIIや機密情報を含む可能性のある列を自動で特定する。 ・コード不要のマスキング:コードを記述することなく、データセット内の情報を自動で識別し、「墨消し」「ハッシュ化」「暗号化」といったデータマスキングを適用できる。 |

| 自動化 | レシピを保存して定期的にジョブを実行可能 |

| スケーラブル | フルマネージドでリソース管理不要 |

[構成要素]

| データセット | S3、Redshift、RDS、JDBCなどから接続可能なデータソース |

| プロジェクト | データをプレビューしながら変換処理を設計する作業スペース |

| レシピ | 実行する変換処理のステップを記録したもの(料理のレシピのようなイメージ) |

| ジョブ | レシピをデータセットに適用して処理を実行する単位 |

Redshift ML

AWS のデータウェアハウスサービス「Amazon Redshift」に機械学習機能を統合したもの。SQL を使って直接機械学習モデルを作成・トレーニング・デプロイできるのが最大の特徴。

主な特徴

| SQLだけでMLモデルを構築可能 | PythonやJupyterなどを使わず、RedshiftのSQL文でモデル作成・予測ができる。 |

| SageMakerと連携 | 実際のトレーニングは Amazon SageMaker が裏で処理。AutoML によるアルゴリズム選定や前処理も自動化される。 |

| データ移動不要 | Redshift内のデータをそのまま使えるため、S3へのエクスポートなどの手間が省ける。 |

| 教師あり・教師なし学習に対応 | 回帰、分類、クラスタリング(K-Means)など、基本的なMLタスクに対応している。 |

Q Business

AWSが提供する企業向け生成AIアシスタント。社内の情報を活用して、業務効率化や意思決定支援を行うための強力なツール。

特徴と構成要素

[主な特徴]

| 社内データを活用した自然言語対話 | 社内文書、営業資料、技術マニュアル、人事規定などを元に、チャット形式で質問に回答 |

| RAG(検索拡張生成)による高精度な応答 | インデックス化された情報を検索し、生成AIが回答を生成 |

| 多様なデータソースと連携 | Amazon S3、Salesforce、Microsoft 365、Dropbox、Google Driveなど40以上のコネクタに対応 |

| セキュアな認証・認可 | AWS IAM Identity Centerを利用し、ユーザーごとのアクセス制御が可能 |

[機能構成]

| コンポーネント | 概要 |

|---|---|

| データソースコネクタ | 社内外の情報を取り込むための接続機能 |

| インデックス | 取り込んだデータをAIが使いやすい形に変換(StarterとEnterpriseの2種) |

| Retriever | 質問に応じて適切な情報をインデックスから取得 |

| LLM | Amazon Bedrockを裏で活用し、自然言語応答を生成 |

| Web UI | ブラウザやSlack、Teamsなどから利用可能 |

その他機能

●ContentBlockerRule

Amazon Q Businessのガードレール機能の一部であり、ユーザーが制限されたトピックや禁止されたフレーズに触れた際の応答方法を制御するためのルール。制限されたトピックについて質問されたことをエンドユーザーに通知し、次にとるべき手順を提案するカスタムメッセージを設定することができる。

| 項目名 | 説明 |

|---|---|

| systemMessageOverride | ブロックされたトピックに関する質問を受けた際に表示されるカスタムメッセージ。最大350文字まで設定可能。 |

| パターン制約 | メッセージはUnicode制御文字を含まない必要があります(正規表現: ^\P{C}*$) |

| 必須かどうか | systemMessageOverrideは任意。設定しない場合はデフォルトメッセージが使用されます。 |

●グルーバルコントロール

アプリケーション全体の全ての対話に適用される。

| 応答の設定を制御 | 大規模言語モデル(LLM)が直接答えを返すが、企業データソースを参照しながら答えを返すかなどの応答設定を制御 |

| 用語をブロック | 特定の用語の使用をブロックし、機密情報やセンシティブなフレーズの生成を回避 |

| ファイルアップロードの制御 | エンドユーザーによるチャット内でのファイルアップロードの可否を制御 |

| Amazon Q Apps の制御 | エンドユーザーによるAmazon Q Apps の作成・利用の可否を制御 |

API参照ルール

サブスクリプションプラン

| プラン名 | 月額料金 | 主な機能 |

|---|---|---|

| Amazon Q Business Lite | $3 | チャットによる質問応答 |

| Amazon Q Business Pro | $20 | アプリ作成、カスタムプラグイン、QuickSight連携などが可能 |

Trainium

AWSが提供する機械学習トレーニングに特化した、高性能かつエネルギー効率が高い機械学習トレーニング専用のインスタンス。

・一般的なGPUよりもコスト効率が高く、消費電力を抑えながら高速なトレーニングを実現。

・TensorFlowやPyTorchなどの主要なフレームワークに対応。

EC2 Trn1インスタンス

AWS Trainiumチップを搭載し、大規模言語モデル(LLM)などの高性能な深層学習(DL)トレーニングのために設計されている。他のEC2インスタンスと比較して、トレーニングにかかるコストを最大50%削減できるとされている。Trnシリーズは、機械学習トレーニングに特化しており、エネルギー効率が「非常に高い」と評価されている。

Mechanical Turk(MTurk)

人間の判断が必要な小さな仕事(タスク)を、世界中の人に依頼してこなしてもらう仕組み。18世紀の「メカニカル・ターク(自動チェスマシン)」にちなんで、「機械のように見えるが実は人間がやっている」ことを表現。

| 依頼者(リクエスター) | 企業や研究者など。タスクを投稿して報酬を設定。 |

| 作業者(ワーカー) | 世界中の個人が参加可能。好きなタスクを選んで報酬を得る。 |

・依頼者は、ウェブUIやAPIを通じてタスクを提出し、人間の作業者がそれを完了・提出する。

・作業者はタスクを選んで実施し、完了後に報酬を受け取る。

・APIを用いたやり取りは、リモートプロシージャコールのような形式で行われる。

・実質的には「人力による人工知能」のような仕組みで、柔軟で多様なタスク処理が可能。

[タスクの例]

・画像に写っているものを分類する

・音声を聞いて文字起こしする

・アンケートに答える

・AI学習用のデータにタグをつける

[公式サイト引用]

IoT サービス

基礎知識

●AWS IoT

IoTデバイスとAWSクラウドサービスをつなぐための仕組み。AWSは、デバイスとクラウドを連携させるためのデバイス向けソフトウェアも提供しており、これによりIoTソリューションの構築がスムーズになる。

IoT Core

【センサーデバイスに特化】

インターネットに接続されたデバイスから、クラウドアプリケーションやその他のデバイスに簡単かつ安全に通信できるクラウドサービス。大量のIoTデータを効率的に収集することができる。リアルタイムには不向き。

※MQTTプロトコルをサポートしている

・ 数十億のデバイス、メッセージをサポートし、それらメッセージをエンドポイントや他デバイスに確実かつセキュアに処理してルーティングする。

・アプリケーションがインターネットに接続されていない場合でも、すべてのデバイスを常に追跡して通信できる。

[使用例]

・産業、コンシューマー、商業、オートモーティブ用のワークロード向けに IoT サービス。

・センサーデバイスを利用した車両管理アプリケーションを容易に構築することができる。

※AWS IoTの仕組み

IoT Core Basic Ingest

IoTデバイスからのメッセージをメッセージブローカーを経由せずに直接ルールエンジンに送信できる機能。

[主なポイント]

| コスト削減 | 通常のメッセージングではメッセージブローカーを通すためコストが発生しますが、Basic Ingestを使うとその部分のコストを削減できる。 |

| 用途 | デバイスからのデータを他のデバイスに配信せず、ルールアクション(例:Lambda実行、S3保存など)だけを実行したい場合に最適。 |

| 使い方 | 特定のトピック形式(例:$aws/rules/ルール名/トピック名)でメッセージをパブリッシュすることで利用できる。 |

| 注意点 | 他のデバイスが同じトピックをサブスクライブしている場合は使えません。あくまで単方向の処理に向いている。 |

MQ for RabbitMQ

メッセージキューイングシステムとしての利用が主である。

IoT Fleet Wise

特定のフリート管理ソリューション向け。

IoT Greengrass

【ローカルでAWS処理】

クラウドの処理能力をエッジデバイスに拡張するためのサービス。ネットワークが不安定な環境でも、ローカル、オンプレミスでデータ処理やアクションが可能になる。

[特徴]

| リアルタイム性 | クラウドに頼らず即時処理が可能 |

| コスト削減 | 不要なデータ送信を減らし、通信コストを抑制 |

| 信頼性 | オフラインでも動作するため、遠隔地でも安心 |

主な機能

| 機能 | 説明 |

|---|---|

| ローカル処理 | Lambda関数をエッジで実行し、リアルタイムでデータ処理が可能 |

| クラウド連携 | S3やIoT Coreと連携して、データの保存や通信がスムーズに行える |

| 機械学習モデルの展開 | SageMakerで作成したモデルをエッジにデプロイして、ローカルで推論が可能 |

| セキュリティ | TLS通信、認証、アクセス管理など、セキュアな運用が可能 |

| コンポーネント管理 | モジュール式で必要な機能だけを選んでデプロイできる柔軟な構成 |

24/06/27 JAWS名古屋:「× Media-JAWS@中京テレビ」参加記録

前置き

先日参加したJAWS名古屋の活動、「Media-JAWS@中京テレビ」技術交流会の参加記録です。

仕事の環境が変わり、今からでも積極的に情報網を広げてフットワーク軽く成長したいと思い始まった本年度。初めてのJAWS名古屋参加でした。

発表内容

下記にて発表内容の概要記載します。

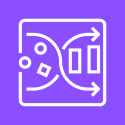

①ゼロからのデータ分析基盤立ち上げ1年間の歩み

まずは中京テレビとAWSのなりそめを下記のように紹介いただく。

★中京テレビではAWSを使用している

| 2016年 | 素材のクラウド上PVシステムでAWSを利用 | ベンダー |

| 2018年8月頃 | インターネット関連部署の担当者がアカウントを作りテスト開始 | 内製 |

| 自社HP基盤のCDNをAWSに切り替える | グループ会社 | |

| 2019年3月頃 | 自社HP基盤をすべてAWSに切り替える | グループ会社 |

| 2020年4月頃 | 在名4名共同配信PFでAWSを利用 | グループ会社 |

| 21年~ | 事業開発にて外部でAWSのサービス制作(運用後の管理のみ依頼) | グループ会社 |

| 配信関連のデータやりとりでAWS S3を利用するなどのニーズに対応。配信視聴結果データ、各基幹システムデータなどの集約の検討が始まる。 | 内製 |

これら取り組みの一環で第一の課題となったのはアカウント管理(IAM)とコストパフォーマンスでした。

クレジットカード情報の残留や支払い元が退職予定の社員だった場合などと、初歩的ながら忘れがちなこと。散見するアカウントの管理、テスト設定が残っていたために課金が発生したなどと。。。

簡単ながら課題と対策を展開いただいた。この知識は有難く得た知識として別個記載することにします。

様々な問題を経て、ベンダーのサポートを受けながらも数年で内製化。

ETL(複数データの抽出・変換・書き出し)監視の環境を確立された。放送されたものはもちろん、Youtubeなどの動画コンテンツサービスやSNSを対象として、統合ダッシュボードに表示できるようになったとのことです。

※以前までは各サービスごとのダッシュボードを個別に確認されていたようです

クラウド導入の一例を簡単に知ることができたこと。また、TV局という仕事上では関りの少ない業界の取り組み、システムを知ることができたのはとても有益でした。

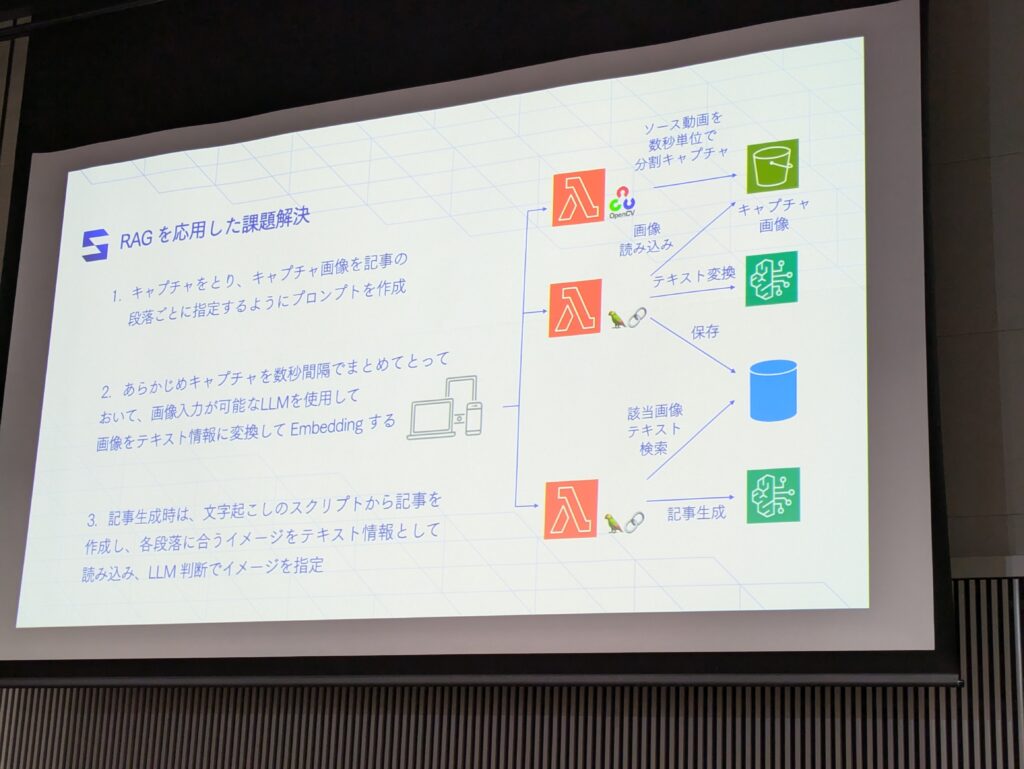

②固定費用0円の完全サーバーレス(AWS)なRAG構成と業務効率化事例紹介

続いても放送業界に関する内容。AWS Summitでも話題沸騰だった BedRockを利用した取り組みでした。

※BedRockの概要

・各種生成AIのモデルをAWSが提供するAPIを通して利用できるマネージドサービス。

・他のAWSサービスとの統合が簡単、多様なモデルをAWSマネージドコンソールで試せる

一例として挙げられたのは、北海道テレビ放送で放映されたコンテンツの情報をブログに自動的に書き起こすというもの。

流れとしては以下のよう。

動画のキャプチャを撮って生地の内容と関連するように指定する方法

①動画ファイルをS3に入力

②Transcordeにて、オーディオから文字を起こす

③OpenCVで記事に使用するキャプチャをとる

④キャプチャした画像を記事の段落ごとに指定するように、Lambdaで処理する

⑤キャプチャをテキストに変換・保存

⑥キャプチャを活用して記事生成

※記事作成時は文字お越しのスクリプトから記事を作成し、各段落に合うイメージをテキスト情報として読み込み

※OpenCVは、プログラミング初心者でも気軽に画像処理・画像解析を行うことができる

ただ文章や画像を並べるだけでなく、文章・トピックの間隔、最良の画像を選出、設定するようなシステム構成になっており、人間が手動で執り行ったものと同等の完成度と感じました。

AI技術が日々進化していることを実感せざるを得ない、そんな講演でした。

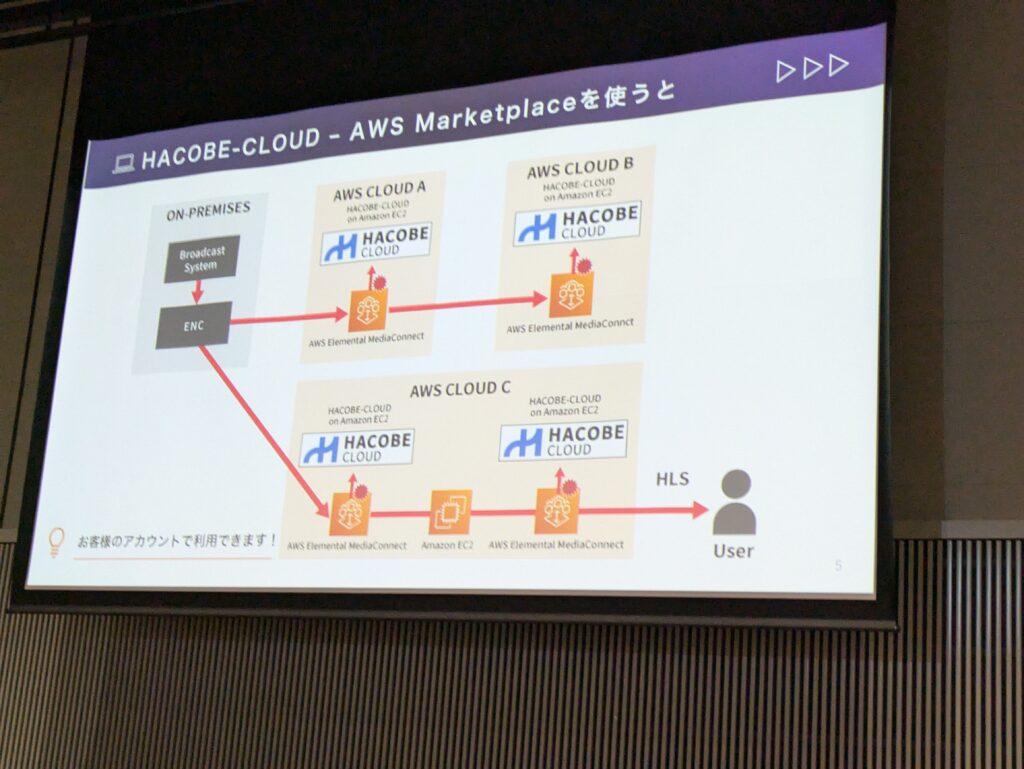

③自社サービスをお客様が簡単に利用出来る為にやったこと

トラフィック・シム社 で展開しているサービスとAWSを掛け合わせた内容でした。

コンテンツは「営業を介さずサービスを提供」「顧客のニーズに素早く対応」と感じました。

上記実現のために利用したAWSサービスは以下2つ。

【1】AWS Market Place

厳選されたデジタルカタログ。

ユーザーはサードパーティーのソフトウェア、データ、サービスを検索、購入、デプロイ、管理してソリューションを構築し、ビジネスを運営できる。企業側は手軽に出品することができる。

また、ユーザーに発生する料金はAWS内で一元管理される。

【2】ECR Public Gallery

Amazon ECR パブリック リポジトリでホストされているコンテナイメージを検索して共有するための公開 Web サイト。

Docker Hubの代替として利用できるコンテナレジストリ。AmazonによりDocker Hubのイメージが複製され公開されている。

「ECR Public Gallery」はこの時初めて知ったサービスでした。これを活用してトラフィック・シム社は自社サービス「MediaHarbor」を以下のように展開されているとのこと。

①サービス提供元に登録し、APIキーを入手➡ライセンス管理

②EC2を立ち上げ、提供された手順書にならいコマンドを実行

③ECR Public GalleryからMediahaborをインストールすることができる?

結果として・・・

・コンテナやインストーラーは無料配布

・インストーラーですぐ構築(オンプレ/クラウド)

・利用時間でのポイント消費型であるため、使用分だけ課金される

・ユーザーの思い付きに対応して提供できる

➡数クリックで提供が早く、営業の代替ともなる

④AWSアーキテクチャ図をスマートに描く方法を試してみた

普段業務上で使用するであろう(?)インフラ構成描画ツールの比較を以下のように所感や経験を交えて説明いただきました。

・draw.io

手軽に作図できる。アイコンも豊富。割と新しい。

・PlantUML

UML図作成用のテキストベースツール。アイコンは割と新しいが、思ったように配置できない

・Mermaid

テキストベースの作図ツール。AWSアイコンセットがないため、色と形で工夫が必要

・Diagrams

Pythonコード図で生成。アイコンセットが古い。

・EraserAI

生成AIを使って自然言語(プロンプト)での作図もできるツール。図をCode化できる。

私もたまに使用するため、こんなに種類があるのだと驚きました。

普段、Cacooというものを使って……Cacooがない。。。。

所感としては状況応じて使用することが有効かなと感じました。

大衆の中で概要を説明するのであれば数メートル離れていても理解できる配色、図解を用いれるツール。AWSサービスに詳しくない人に説明する人にも同様。

詳しい方にはしっかり目で追う必要のある描画図。

これらはどのように描くかということも大事ですが、如何に説明し理解を得るかが重要なポイントだと常日頃感じています。それを実現するための「やり方」を本講演は教えてくれたと感じました。

⑤プレゼント応募システム費を97%削減した話

東海テレビ と外部ベンダーとのお付き合いでクラウド化に成功した事例。

タイトル通り、プレゼントの応募システムへのアクセス集中に耐えれるようにしたとのことです。

お話いただいたことを以下にまとめます。

【困りごと】

・全国のネットスポーツ中継

・ドラマで出演者が某事業所

・プレゼントを番組で煽りまくった(キャッシュなど)

【達成要件】

・毎分10,000は華麗にさばきたい

・ユーザーフォームは無制限

・とにかく安いやつ

【旧構成】

LB(日立ArraysOS)の背後にWebSV(Apache)×2をフロント、バックエンドにDB(Postgresql)

→セキュリティのポイント:自分で作らない

→WAF:たまに誤検知が発生することが少し悩み

【コンセプト】

・特別な設定なしで大量アクセスOK

・コストカット

・セキュリティにも気を遣いたい

【流れ】

簡単な下図を書いた後に、TOKAIコミュニケーションズ社に依頼。

●背景

・ハードウェアのサポート期限が迫っている

・メンテナンスにかかる費用負担分とコスト削減などのクラウドストサービスによるメリットを享受したい。

・サーバーに接続する信頼性の高い回線を冗長構成で実現したい。

●導入サービス

・AWS接続サービス

・AWS運用管理

●効果

・本社とAWSを結ぶ接続回線を冗長化しセキュア且つ信頼性の高い接続環境を実現

・業務システム群のAWS意向を見据えたAWS環境を構築

・専用サポートプランの採用でVPC間の通信が容易になった

【結果】

・毎分32,000件裁けるように

・ユーザー・フォーム数は無制限に

・利用費が97%安くなった(人件費を入れたらもっと!)

出来上がった本システムは5万円で運用できているらしいです。

クラウドを導入するための第一歩の動きとして、とても参考になります。

ただ、ベンダーにすべて任せては知識が付かない、という考えもあるため、ここからどのように内製に繋げたかとても気になるところです。

私も懇親会(講演の後のお食事会)に参加すればよかったでしょうか・・・

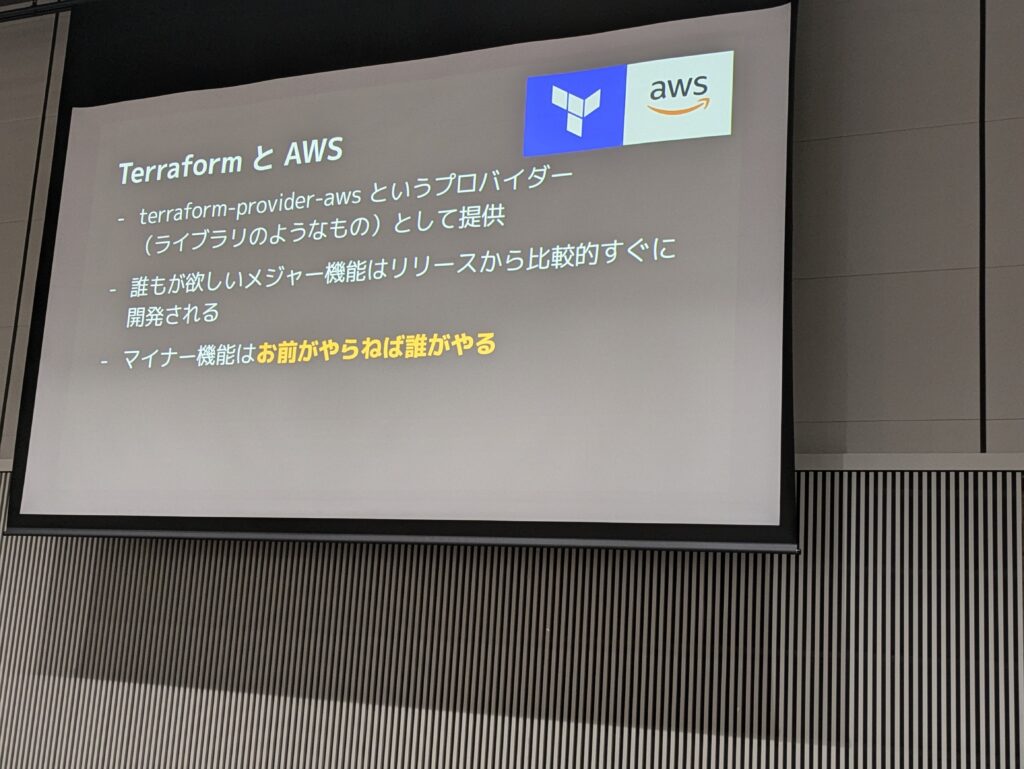

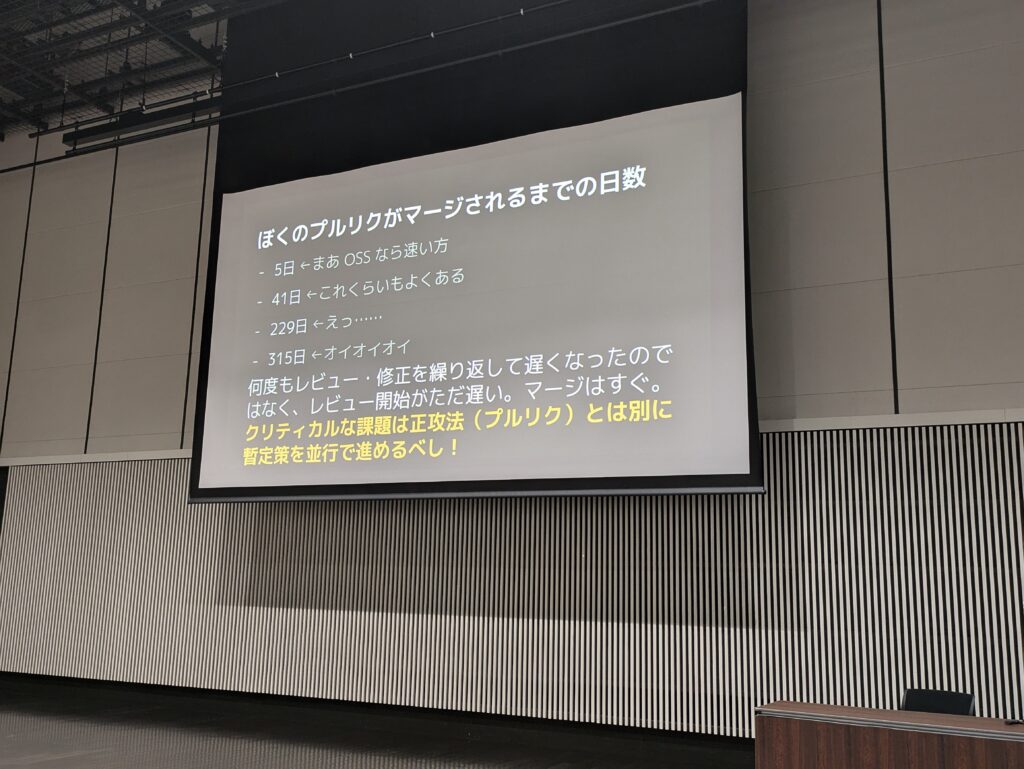

⑥terraform-provider-aws にプルリクしてマージされるまで

開発者サイドの苦労、葛藤をお話いただきました。開発側の動きは認識があまいため、やんわりとしたイメージしか持てませんでした。

概要としては、Terraform上でのプルリクエスト(略称:PR)~マージまでの苦労と葛藤です。

Terraform とは書き上げたコードからクラウド環境を構築ができるという優れものです。

AWSには同等のサービスとして、CloudFormationがありますが、、、確か汎用性や機能性の面でTerraformが推進されています。

このTerraformにAWSが 「Terraform provider aws」 というプロバイダー(ライブラリのようなもの)を提供しているようです。これにより、Terraform上での開発、展開、技術促進が捗る?ということでしょうか。見聞きしていたところ、GitHubと同じような位置づけと感じました。

以下、登壇いただいた方からのコメントです。

【プルリクするまではスムーズ】

・プルリクで従うべき手順がドキュメントに書いている

・ざっくりいえばAWS SDKを使ってリソースを探したり、変更するだけ。普段SDKでアプリ開発しているのと同じ

・どのAWSも設計がほぼ一緒であるため、既存コードを参考にすぐ書けるものもあった。

・受入テスト(実際のAWSにデプロイして実行)もコード化されてっるので、動作確認も簡単だった。

➡ただ、プルリクがマージされるまでに時間がかかる。

terraform providerにPR(プルリクエスト)を出したが、管理元に中々マージしてもらえない・・・そんな内容でしょうか。

⑦Amazon IVS: 新しいインタラクティブメディア体験を実現する

AWSご所属の Hao Chen氏に登壇いただきました。

カナダ支部(?)所属の方でご多忙の中、お時間をいただけました。

AWSで音声配信サービスを展開されており、その取り組みについて発表いただきました。

その音声配信サービスとは「Twitch」です。

※Twitch:Twitch Interactive(Amazon.com子会社)が提供するライブストリーミング配信プラットフォーム

このサービスを実現させるAWSサービス、それは「Amazon IVS」。これまた初耳です。

- Amazon IVS

世界中の視聴者が低レイテンシーまたはリアルタイムの動画を利用できるようにするマネージド型ライブストリーミングソリューション。これにより、魅力的なライブ体験を実現できる。

・Twitchを支えるネットワークとインフラ

・累計一年間1.35兆分ものライブ動画再生

・低遅延(2~5秒)のHLSストリーミング

・超低遅延(300ms)のWebRTCのストリーミング

・ストリームチャット(WebSocket)

まだアソシエイトレベルの知識しかありませんが、ライブストリーミングサービスを配信したいから・・・なんて問題は出てきていません。

今後のことを視野に学ばせていただきました。

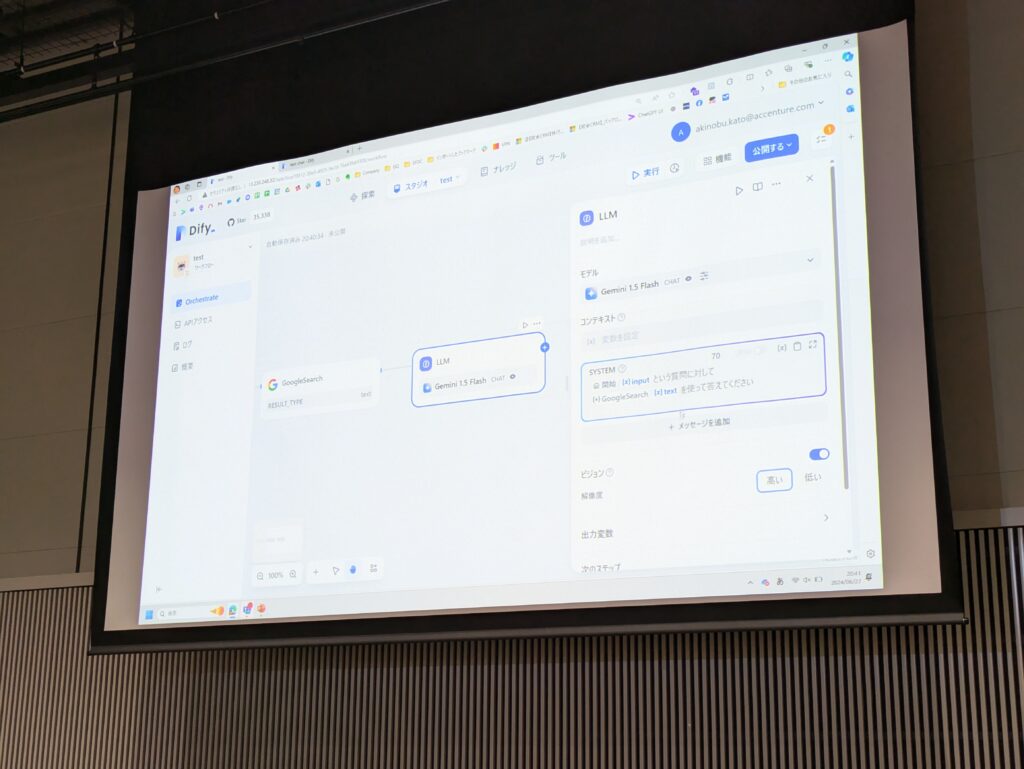

⑧AWS上で構築する生成AI実行環境(Dify のローカル環境構築)

アクセンチュア社から今流行りの生成AIについて発表いただいた。

生成AIということで発表いただいたサービス、「Dify」。続けて初耳のサービスです。

AWSでAMIとしても提供されており、超簡単に生成AIのプライベート環境の構築ができるそうです。

- Dify

オープンソースのLLM(大規模言語モデル)アプリ開発プラットフォーム。RAGエンジンを使用して、エージェントから複雑なAIワークフローまでLLMアプリを編成できる。

・GUI画面操作で複雑なタスクを実行するAIエージェントを簡単に作成できる

・複数モデル(ChatGPT、Bedrock、Llamaなど)を包括的に利用可能

・作成したエージェントをAPIとして公開し、既存のアプリケーションに組み込むことができる

・LLMOps 機能が組み込まれている

かつてはチャットボットを便利だ、人件費削減だと歓喜していましたが今や簡単に作れてしまうサービスになってしまったと感じます。

本講演ではDifyを実際に使用したチャットボットの作成を実演いただきました。

GUI操作でとても見やすいですが、設定なり操作感が少し難しそうでした。

⑨完全未経験から民放連盟賞を受賞したシステムを開発するまで

最後はアイスブレイクのようなご講演でした。

HTB北海道テレビ放送(株)にご所属されている方で、どのようにAWSを社内システムにクラウドリフトされたかご講演いただきました。

フランクで明るい巧みな話術で終始リラックスして拝聴しておりました。

クラウド化する際に、雑多なインフラ構成図で外部ベンダーに持ち込んだエピソードはとても印象的であり、始めるためのアクションというのは様々なものだと改めて感じました。

おわりに

初めての名古屋JAWS、総合的に見てもまだエンジニア的観点・思考が不足していると痛感しました。

業務では得られない知見や思考、アイディアは積極的に足を運び吸収すべきだと改めて感じました。

エンジニア業界、様々な方が在籍されていますが、とても親しみやすそうな方ばかりでした。

こういった柔軟性、協調性、探求心に重きをおけるよう方々から今後いろいろ学ばせていただき、成長の糧にしていけるように活動していきたいものです。

そのため、上記でも話のありました懇親会。。。参加したかったのですが、実務経験のなさ故に弱腰になってしまいました。

次は否が応でも、弱さを引きずってでも参加しようと思います。

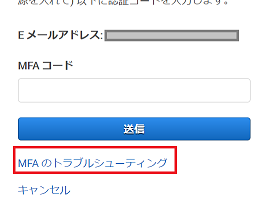

AWS MFA認証 を解除した件

経緯

スミスです。

断捨離がクセになってしまい、時々スマートフォンのアプリも断捨離してしまうことがたまにあります。

その際、たま~に「もう使わないだろうな」と考えずにアンインストールしてしまうことがあります。

そんなわけで、半年ほど前に「Google Authenticator」を消してしまいました。

再インストールしても、情報は残っていません。。。

二度目というのは内緒です。

対応記録

余計な対応を挟んでしまっていますが、生暖かい目で流してあげてください。

①サインインのトラブルシューティング

ルートアカウントにMFA認証をかけていました。

そのため、IDとパスワードを入力すると当然MFA認証を求められます。

画面のように下部に「MFAのトラブルシューティング」とありますので、こちらを左クリック。

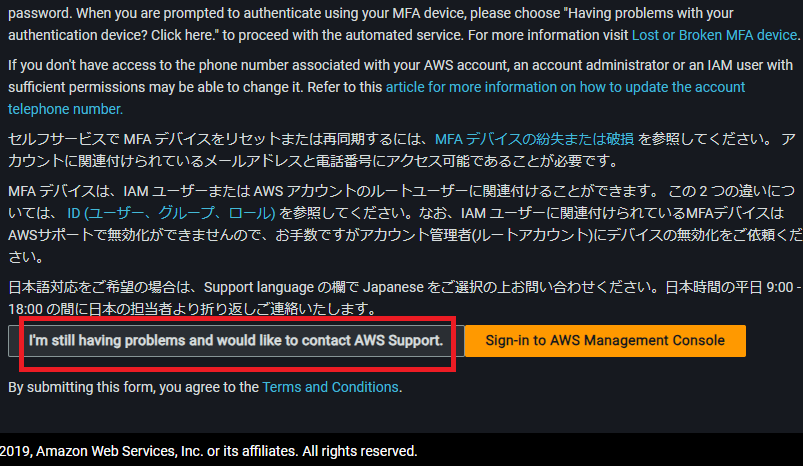

画面が遷移されると、

・ステップ1:Eメールアドレスを検証する

・ステップ2:電話番号の確認

・ステップ3:サインイン

と書かれた画面に記載されています。ここの画像を取り忘れていました。ご容赦願います。

ここで問題なく処理されればいいのですが、「ステップ2:電話番号の確認」で失敗してしまいます。

着信がかかってきませんでした。

「ステップ2:電話番号の確認」が失敗すると、「AWSサポートにお問い合わせください」と対応ページの提案を受けます。

早速、左クリック!

②AWSの問い合わせフォームに移動

「①」の対応にて、下記画像のサイトに遷移します。

ここで私はひとつミスをしました。「Sign-in to AWS~」という方を選択してしまいました。

ログインできないのにコンソール画面に移動するってどういうこと???

そう疑問に悩んだ挙句、安パイで 「AWS問い合わせフォーム」から問い合わせしました。

返信として、上記画像のサイトへと案内されてしまいました。そりゃそうですよね。。。

間違えないように赤枠に記載されている箇所を左クリックで選択しましょう。

すると、画面下部に入力フォームが表示されるようになります。

必要な情報を入力し送信すると、「平日の9時頃に電話がくる」旨、表示されます。

サインインして確認するようなパソコンが必須になる対応はありません。

土日に申請をしている場合は、基本的に月曜日に対応いただけます。

最高過ぎます。

③平日、電話対応

平日の9時にAWSサポートから電話を受領しました。

「氏名」「登録のメールアドレス」を口頭確認した後に、MFA認証をリセットしてもらえました。

以降、AWSのルートアカウントには、「ID , パスワード」のみでサインインできるようになります。

つまり、初期登録の状態にもどることになります。

最後に

AWSサポートの方、私の断捨離がご迷惑をおかけしました。。。

Encrypt

基礎知識

●共通鍵暗号

鍵は1つ使う。

暗号化と復号に同じ鍵を使う、高速に暗号化、復号できる。安全な受け渡し、保管を実現。ストレージの暗号化に使用されるケースが多い。

●公開鍵

鍵は2つ使う。公開鍵認証形式(非対称鍵暗号)

鍵を持っている人からのみ、一般ユーザーのログインを許可する。 公開鍵と秘密鍵のキーペア。

- 秘密鍵ファイル:パソコン側に置く

- 公開鍵ファイル:サーバー側に配置する

公開鍵で暗号化したデータは秘密鍵で復号できる。共通鍵暗号と比べて、複雑で処理は重い(CPU能力を使う)暗号化に加えて、デジタル署名やデジタル証明書に使われる技術。

※受信者は鍵のペアを予め作っておき、公開鍵を送信者に渡しておく

※公開鍵認証ではログイン時に「パスフレーズ」を使用する

[共通鍵と公開鍵の併用]

共通鍵を公開鍵で暗号化し、復号は秘密鍵。実際の通信は共通鍵暗号で暗号化/復号を行う。

安全性とパフォーマンスの両立を実現。

KMS

(Key Management Service)【鍵管理サービス】

データ暗号化に利用する暗号化(または復号化)できるKMSキーの作成・管理を行うためのAWSのマネージドサービス。AWS所有のマルチテナント管理を共有で利用し、耐久性が高く、高可用性である。

- 鍵の保管:KMSキーを安全に保管するストレージ(安全なロケーションの提供)

- 鍵の管理:KMSキーのライフサイクル管理、及び鍵の管理や利用に対する認証・認可・記録するアクセス制御

[参考]

・他のAWSと連携しやすい(S3サーバー、オブジェクト側の暗号化など)(連携するAWSサービス:50以上)

・CloudHSMに比べると安価に利用でき、手軽に暗号化キーを管理

・キーの使用・管理の監査証跡として、有効

[独自のキーマテリアルの場合]

独自のキーマテリアルをインポートするには、最初にキーマテリアルなしで KMS キーを作成。そして、独自のキーマテリアルをインポート。キーマテリアルなしで KMS キーを作成するには、AWS KMS コンソールまたは CreateKey オペレーションを使用する。キーマテリアルなしでキーを作成するには、オリジンとして EXTERNAL を指定。

- キーマテリアル

CMKのメタデータを除く暗号・復号に利用する部分。

鍵の種類

| マスターキー | ・データキーを暗号化する ・AWS内部で永続化される ・ユーザーがローカルにエクスポートできない |

| データーキー | ・データを暗号化する ・AWS内部で永続化されない ・ユーザーがローカルにエクスポートできる |

[マスターキーの種類]

●KMSキー(CMK3種類)

データの暗号化、復号、再暗号化を行い、外部が使用するデータキーを作成する。キーストアに厳重に格納される。KMS キーには、キー ID、キー仕様、キー使用法、作成日、説明、およびキーステータスなどのメタデータが含まれる。

| カスタマーマネージドキー (カスタマーマスターキー) | ユーザーが作成するKMSキー。データーキーを暗号化するための鍵。削除した直後であれば、削除のキャンセルができる。 |

| AWSマネージドキー | AWSがユーザーのAWSアカウントで作成するキー。AWSサービスが作成・管理・使用するCMK。 キーの名前は「aws/サービス名」。このため、名前の先頭に「aws」を付けられない。 3年ごとに自動ローテーション。 |

| AWSが所有するキー | AWSがユーザーのサービスアカウントで作成するキー。ユーザーからは見えない。 |

[データーキー]

●CDK(Customer Data Key)

対象のデーターを暗号化するための鍵(データキー)。

※公式の資料ではCDKという言葉はほとんど使われていない

[使われている関連記事]

暗号化(エンベロープ暗号化)

AWS KMS はセキュアで弾力性の高いサービス。データーキー、マスターキーを用いる。

暗号化や復号の際にはKMS(またはCloudHSM)に鍵の使用リクエストAPIを送信し、データキーを一時的に復号化して暗号化、復号する。

[暗号化機能] (参考)

- Encrypt:文字通りデータを暗号化するためのAPI(4KBまでの平文字に対応)

- Decrypt:復号のためのAPI

- GenerateDataKey:ユーザーがデーターの暗号化に利用するための、カスタマーキーを作成する

[暗号化流れ]

- アプリケーションから AWS SDK の GenerateDataKey オペレーション(キーID)を使って CDK を生成。

- 作成されたCDKをCMKで暗号化する。CMKはデータキーを2つ作成する。

※認識が混ざるためCDKという単語は不使用

・データーキー:「A」とする

・暗号化されたデーターキー:暗号化された「A」とする - ユーザーは工程「2.」で作成された、「A」で暗号化したいデータを暗号化する。

後に、「A」は削除して、暗号化された「A」を手元に残す。

[復号化の流れ]

- 暗号化された「A」をKMSに送る。

- CMKが暗号化された「A」と「A」を結果として返す。

- ユーザーは結果として返された「A」でデータを復号化。不要であれば「A」は削除。

キーの管理

●KMS Generate Data Key

アプリケーションでデータをローカルで暗号化することができる。一意の対象データキーを生成する。データキーのプレーンテキストコピーと、指定したCMKで暗号化されたコピーを返す。プレーンテキストキーを使用して、KMSの外部でデータを暗号化し、暗号化されたデータと主に暗号化されたデータキーを保存できる。

●マルチリージョンキー

複数のリージョンで同じように KMS Key を相互使用ができる。関連するマルチリージョンキーセットごとに、同じキーマテリアルおよびキーIDがあるため、1つのAWSリージョンでデータを暗号化し、再暗号化やAWS KMS へのクロスリージョン呼び出しを行うことなく異なるAWS リージョンで復号できる。

・キーは個別に管理、独立して使用、連携させて使用することもできる。

[自動キーローテーション]

KMSで生成した各キーマテリアル(ベース)を年次(1年)で更新する。エイリアス、Key ID、Key ARNは新キーに引き継がれる。

・古いキーマテリアルがすべて永続的に保存する。削除されない限り、KMS キーで暗号化されたすべてのデータを復号できる。

・サポートするのは、AWS KMS が作成するキーマテリアルを持つ対称暗号化 KMS キーのみ。(インポートしたCMKは対応不可)

・KMS キーのキーマテリアルに関するローテーションの追跡は、Amazon CloudWatch とAWS CloudTrail で実行できる。

連携サービス

[CloudTrailとの統合]

・KMSで内ユーザーやロール、またはAWSのサービスによってじっこうされたアクションを記録。

・KMSコンソールからのコールやKMS APIへのコード呼び出しを含むKMSのすべてのAPI呼び出しをイベントとしてキャプチャし、証跡を作成。

(リクエスト作成元のIPアドレス、リクエストの実行者・実行日など、)

・すべてのキーの使用ログを表示できるため、規制およびコンプライアンスの要求に応えるために役立つ

Cloud HSM

(Hardware Security Module)

ハードウェアセキュリティモジュール(HSM)を使用した暗号鍵管理サービス。KMSに比べると高価。

※HSMインフラの管理責任:ユーザー⇒AWS クラウドで暗号化キーを簡単に生成して使用できる

・HSMのFIPS認定 :FIPS140-2 Level 3(3認証済み)

・KMS経由でAWSサービスと連携可能。

・異なるリージョンからCloudHSMにアクセス出来ない

・バックアップイメージを異なるリージョンに転送してサービスをリストアすることは可能。

・VPC外からアクセスする場合には、CloudHSMがあるVPCにルーティングする必要がある

[サポートする暗号鍵]

共通鍵と公開鍵。占有タイプ(Amazonの管理者もアクセスできない)のハードウェアで暗号化キーを保管(不正防止機能を装備したハードウェアデバイス内でキーを操作)

・物理デバイス制御とキーへのアクセスを持たないアプリケーションで秘密鍵を強力に保護できる。そのため、キーがAWS環境の外に移動されない。

[オフロード機能]

CloudHSM クラスターの HSM に対するHTTPS同様の計算の一部をオフロードできる。ウェブサーバーの計算負荷が軽減され、サーバーのプライベートキーを HSM に保存するとセキュリティが強化される。このプロセスは、SSL アクセラレーションとも呼ぶ。

・ウェブサーバーとそのクライアント (ウェブブラウザ) では、SSL または TLS を使用できる。

※一般的に HTTPS として知られており、パブリック/プライベートのキーペアと SSL/TLS パブリックキー証明書を使用して、各クライアントとのHTTPS セッションを確立するため、このプロセスは、ウェブサーバーにとって多くの計算を伴う。

Secrets Manager

【認証情報管理】

データベース認証情報、アプリケーション認証情報、OAuth トークン、API キー、およびその他のシークレットを安全に暗号化し、アクセス管理情報を一元的に監査する。それらシークレット情報を、Secrets ManagerへのAPIコールに置き換えて取得できる。各サーバからAPIを叩くことでシークレット情報を取得でき、認証やサーバセットアップに利用できる。(アプリケーションにシークレット情報を保存する必要がなくなる)

AWS のサービスの多くは、Secrets Manager にシークレットを保存して使用される。

※アプリケーションにシークレット情報を保存する必要がなくなる。

・ライフサイクルを通じて「管理」、「取得」、「ローテーション(Rotation Schedule)」することができる。

シークレット

パスワード、ユーザーネーム、APIトークン、データベース認証、パスワードなどの一連の認証情報、OAuth トークン、または、暗号化された形式。

[参考サイト]

[アクセス]

・きめ細かい IAM とリソースベースのポリシーを使用して、シークレットへのアクセスを管理する。

・各シークレット情報は各サーバーからAPIを叩くことでシークレット情報を取得でき、認証やサーバセットアップに利用できる

・シークレットはデフォルトで KMS によって暗号化されるが、この暗号化キーの管理はAWSが行う。

[シークレットのローテーション]

(Rotation Schedule リソース)

暗号化された安全なストレージを提供され、シークレット、データベースまたはサービスの認証情報が更新する。定期的なキーローテーションスケジュールを設定できる。

※長期のシークレットを短期のシークレットに置き換えることが可能となり、侵害されるリスクを大幅に減少させることができる。

以下の2つの方式がある。

- マネージドローテーション

・ほとんどのマネージドシークレットで利用される。

・サービス側がローテーションを設定・管理するため、Lambda関数は不要。 - Lambda関数によるローテーション

・その他のタイプのシークレットで使用される。

・ユーザーが用意したLambda関数を使って、シークレットと関連サービス(データベースなど)の認証情報を更新する。

リソースタイプ

Secrets ManagerにはCloudFormationテンプレートの一部として作成できるリソースタイプが複数ある。

| AWS::SecretsManager::Secret | シークレットを作成し、Secrets Manager に保存。パスワードは、ユーザーが指定するか、Secrets Manager に生成できる。空のシークレットを作成し、後でパラメータ SecretString を更新もできる。 |

| AWS::SecretsManager::ResourcePolicy | リソースベースのポリシーを作成し、指定されたシークレットにアタッチ。リソースベースのポリシーは、シークレットに対してアクションを実行できるユーザーを制御する。 |

| AWS::SecretsManager::RotationSchedule | 指定した Lambda ローテーション関数を使用して、定期的な自動ローテーションを実行するようにシークレットを設定する。 |

| AWS::SecretsManager::SecretTargetAttachment | シークレットを作成後、サービスまたはデータベースの作成時にそれを参照して認証情報にアクセスすると、このリソースタイプはシークレットに戻ってその設定を完了する。Secrets Manager は、ローテーションが機能するために必要なサービスまたはデータベースの詳細をシークレットに設定する。 |

S3 の暗号化

デフォルトで暗号化が有効化。HTTPSを使用してデータをS3にプッシュして転送中に暗号化できる。

・転送時:S3との間でデータを送受信するとき。

・保管時:S3データセンター内のディスクに格納されている時。

・HTTP 503 レスポンスとは「サービスが利用できない」ときに表示されるエラー

・Secure File Transfer Protocol (SFTP) を使用して ファイルを直接転送することができる

[暗号化する場所]

- クライアント側

クライアント側でデータを暗号化し、暗号化したデータをS3にアップロードする。

この場合、暗号化プロセス、暗号化キー、関連ツールはユーザ管理。 - サーバー側

送信先で暗号化を実施する方法。暗号化キーによって管理方法が変わる。

オブジェクトをデータセンター内のディスクに保存する前にオブジェクトレベルで暗号化。アクセスするときに復号するようにS3にリクエストする。

[暗号化の種類]

| SSE-S3 S3で管理された 暗号化キー | S3が暗号化キーの生成・管理・保管を行う。そのため、暗号化キーの変更、管理を行えない。 ・各オブジェクトは、強力な多要素暗号化機能を備えた一意のキーで暗号化される。 ・キー自体が定期的に更新されるマスターキーによって暗号化される。 ・256ビットの高度暗号化規格(AES-256)を使用してデータを暗号化。 |

| SSE-KMS KMSで管理された 暗号化キー | AWS KMSが暗号化キーの生成・管理・保管を行う。追加の料金がかかる。 ・任意のキーを用いて暗号化できる ・キー自体へのアクセス制御によって、暗号化・復号化できるユーザーを制御できる ・いつ、だれによってキーが使用されたか、ClouodTrailから監査証跡が提供される。 ・エンベロープキー(データの暗号化を保護するキー)オブジェクトの不正アクセスに対する追加の保護を提供する。 |

| SSE-C ユーザー側で用意した暗号化キー | ユーザー自身が暗号化キーの生成・管理・保管を行う。S3に送信する前にデータが暗号化される。 ・どのキーでどのオブジェクトが暗号化されたのかという情報は自分自身で管理。 ・暗号化・復号化に伴う料金は発生しない ・任意のキーを用いて暗号化することができる ・AES-256暗号化タイプを使用 ・HTTPSだけサポートしている ・キーの管理全般はユーザーであるため、セキュリティ面が弱い。 |

[比較表]

「AWS S3でサーバー側暗号化をしたい」というニーズに応えつつ、セキュリティ運用の方針に合わせて選べるようになっている。「AWSにキー管理を任せて利便性やセキュリティレベルを高めたい企業」はSSE-KMS。

「AWSにキーを預けたくない」「極限まで自分で管理したい」というセキュリティポリシーが厳格な組織やプロジェクトではSSE-C。一番簡単に使える暗号化方式で、「保存時に暗号化されればOK」という基本的なセキュリティ要件にはSSE-S3。クライアント側暗号化はAWS外で処理を完結したい場合に有効。

たとえば、

- 金融や医療分野などで「クラウドでも鍵は一切預けない」といった方針があるならSSE-C。

- 監査対応やIAM連携を重視する企業であればSSE-KMS。

| 観点 | SSE-S3 | SSE-KMS | SSE-C | クライアント側暗号化 |

|---|---|---|---|---|

| キー管理 | AWSが自動的に管理(AES-256) | AWS KMSで管理されたキー | 顧客が自分で管理・提供 | 顧客がローカルで暗号化・管理 |

| 利便性 | 高い:設定だけで利用可能 | 高め:KMS連携の設定が必要 | 低め:毎回キー提供が必要 | 低め:全て手動で管理する必要あり |

| 監査・制御 | CloudTrail対象外 | CloudTrail対応・IAM制御可能 | CloudTrail対象外・制御困難 | 自前で監査ログを準備する必要あり |

| コスト | 無料 | KMS利用料が発生 | 無料(但し運用負荷高) | 暗号化ツールの導入コストあり |

| セキュリティ水準 | 基本的な保護(AES-256) | より強力・柔軟な制御 | 顧客が鍵を持つため強力 | 最も厳密な管理が可能(自己責任) |

| 代表用途 | 一般的な暗号化要件を満たす用途 | 企業・監査向け用途 | 金融・法務など高セキュリティ用途 | 機密性重視の組織や独自運用環境 |

分析サービス

基礎知識

●ETL

(Extract(抽出)Transform(変換)Load(格納))

社内に点在する情報(データ)を必要な情報(データ)のみ1箇所に集約し蓄積し、経営に役立つ洞察を得るために利用する。

※これまでは情報を蓄積させるにも異なるデータソースであったため、各開発工数と専門知識が求められた

[RPAとの違い]

RPAツール:既存のアプリケーションの利用を前提とする。

ETLツール:ツールを利用してデータの収集や加工を行う。

| サブセット | 一部分、部分集合、下位集合などの意味を持つ英単語。ある集団全体を構成する要素の一部を取り出して構成した小集団のこと。ITの分野では、仕様や規格、データ集合、ソフトウェアの機能などについてよく用いられる用語。本来備えている要素の一部を省略・削除した簡易版、限定版、軽量版という意味で用いられることが多い。 |

| ヒューリスティック | 必ず正しい答えを導けるわけではないが、ある程度のレベルで正解に近い解答を得ることができる方法。答えの精度が保証されない代わりに、回答に至るまでの時間が少ない。 |

| データパーティショニング | スキャンされるデータ量が最小限に抑えられ、パフォーマンスが最適かされ、S3での分析クエリのコストが削減される。データへのきめ細かいアクセスも向上。 |

●Fluent Bit

・Kubernetes対応:DaemonSetとして簡単にデプロイ可能。PodやNodeのログ収集に最適

・用途:ログの収集、処理、転送(ログルーターとして機能)

・軽量設計:C言語で実装されており、メモリ使用量が非常に少ない(数MB程度)

・対応フォーマット:JSON、CSV、Apache/Nginxログなど、さまざまな形式に対応

・出力先:Amazon S3、CloudWatch Logs、Elasticsearch、Kafka、Splunk、Datadog など多数

| 機能 | 説明 |

|---|---|

| Input Plugins | ログの取得元(ファイル、systemd、TCP、Kubernetesなど)を指定可能 |

| Filter Plugins | ログの加工(タグ付け、除外、JSON変換、Grepなど) |

| Output Plugins | 転送先の指定(S3、CloudWatch、Elasticsearchなど) |

| パフォーマンス | 高速処理と低リソース消費で、IoTやエッジ環境にも適している |

Quick Sight

【ダッシュボード】

クラウド内のデータに接続し、さまざまなソースのデータを結合し、AWSで簡単に分析環境を作ることができるBIサービス。単一のデータダッシュボードに AWS データ、サードパーティーデータ、ビッグデータ、スプレッドシートデータ、SaaS データ、B2B データなどを含めることができる。

※CloudWatchLogsを直接データソースとして利用できない

[参考]

Open Search Service

【ログ等高速検索】

Elasticsearch から派生したオープンソースの分散検索および分析スイート。リアルタイムのアプリケーションモニタリング、ログ分析、ウェブサイト検索などの幅広いユースケースにご利用できる完全なオープンソースの検索および分析エンジン。統合された視覚化ツールである OpenSearch ダッシュボードを使用して、大量のデータへの高速アクセスと応答を提供するための高度にスケーラブルなシステムを提供する。これにより、ユーザーはデータを簡単に探索できる。

Apache Lucene 検索ライブラリを搭載しており、KNN 検索、SQL、異常検出、機械学習コモンズ、トレース分析、フルテキスト検索など、多くの検索および分析機能をサポートしている。ドキュメントやメッセージ、ログ等の様々なデータソースに対してDashboards Query Language(DQL)を使用することでデータの分析や可視化ができるサービス。

※Cloud Frontのログの格納先にOpenSearchドメインを使用することはできない

※本サービスを停止することはできない

[Kibanaへのアクセス制御]

以下設計により、認証とIP制御の柔軟な組み合わせで、Kibanaのセキュリティを強化することが可能。

[認証と保護の方法]

| Amazon Cognito認証(Elasticsearch 5.1以降) | Kibanaにユーザー名とパスワードによるアクセス制限を設定可能。オプション機能。 |

| IPベースのアクセスポリシー + プロキシの利用 | Cognito認証を使用しない場合でも、IP制御とプロキシを使ってアクセス制御が可能。 |

[JavaScriptとアクセス制御の考慮点]

多数のIPをホワイトリストに登録するのは非効率なため、プロキシのIPアドレスからのみアクセス許可する方法が提案されている。KibanaはJavaScriptアプリのため、アクセス元IPは「ユーザーのIP」となり、IPベースの制御が難しくなる。

Compute Optimizer

【リソース評価・分析】

AWS「リソース設定」と「使用率」のメトリクスを分析。機械学習を使って過去の使用率メトリクスを分析することでリソースが最適かどうかを報告し、コスト削減し、パフォーマンスを向上させる。コストを削減しつつパフォーマンスを向上させるための最適化に関する推奨事項を生成する。(EC2、EBS、ECS、Lambdaを対象)

[グラフ機能]

最近の使用率メトリクスの履歴データと、レコメンデーションの予測使用率を示す。最適なコストパフォーマンスのトレードオフとなるレコメンデーションを評価できる。実行中のリソースを移動またはサイズ変更するタイミングを決定し、パフォーマンスとキャパシティーの要件を満たすのに役立つ。

Kinesis

【プラットフォーム】

AWSでデータをストリーミングするためのプラットフォーム。受信するとすぐに処理,分析を行うため、すべてのデータを収集するのを待たずに処理を開始して直ちに応答する。複数のソースから高頻度でストリーミングデータをリアルタイムで収集、処理、分析することが簡単になるため、インサイト(見通し)を適時に取得して新しい情報に低レイテンシーに対応できる。また、特殊なニーズに合わせてカスタムストリーミングデータアプリケーションを構築する。

●ストリーミングデータ

数千ものデータソースによって継続的に生成されるデータ。

[ユースケース]

動画分析、一括からリアルタイムへの移行、動画分析アプリ、リアルタイムアプリなど

Kinesis Data Streams

【シャードの集合体】

次々と送られる大量のデータをリアルタイムに加工、収集、次のサービスに配送するためのサービス。データを中長期保存することを目的としない。そのため、レコードが追加されてからアクセスできなくなるまでの保持期間(Default:24h)がある。(DynamoDBにデータ保存はできない)

仕組み

一連のデータレコードを持つ「シャード」のセット。各シャードのデータレコードには、Kinesis Data Streams によってシーケンス番号(順序)があるため、メッセージが失われず、重複されず、到着と同じ順序で伝送することが可能。サーバー側での暗号化をサポートする。特定の場所に転送することはできない。

(処理速度を向上させるものではない、スループット(処理量)を増加させるもの)

・デフォルトのデータ保持期間は24時間。この期間は、最大で8760時間(365日)まで延長できる。保持期間を延長すると、追加料金が発生する。

⇒データバッファリングや一括処理には不向き

| シャード | Kinesis Datastream内のデータレコードのシーケンス。シャードの増減によってデータの転送速度を変動できる。各シャードには、一連のデータレコードが含まれる。 [参考] 【1つのシャードあたり…】 ・取り込み:1秒あたり最大 2MB のデータ ・書込み:1秒あたり 1,000 レコード ・ストリーム:1秒あたり最大10ギガバイト [引用元公式サイト] |

| データレコード | Kinesis data stream に保存されたデータの単位。シーケンス番号、パーティションキー、データ BLOB (イミュータブルなバイトシーケンス) で構成される。各データレコードには、シャード内のパーティションキーごとに一意のシーケンス番号が割り当てられる。 ※BLOB 内のデータが検査、解釈、変更されることは一切ない |

構成

●プロデューサー(データ送信側)

データレコードを Kinesis Data Streamsに送信する。たとえば、Kinesis data stream にログデータを送信するウェブサーバーはプロデューサー。コンシューマーは、ストリームのデータレコードを処理する。

●コンシューマー(データ処理側)

Kinesis Data Streams からレコードを取得して処理する。これらのコンシューマーは Kinesis Data Streams Application と呼ばれる。S3、Redshift、Splunk などのサービスに直接ストリームレコードを送信する場合は、 Kinesis Data Firehose 配信ストリームを使用できる。

[拡張ファンアウト]

コンシューマーは、シャードあたり 1 秒間に最大 2 MB のデータのスループットで、ストリームからレコードを受け取ることができる。これにより、コンシューマーはスループット性能を向上させることができる。

●Kinesis Client Library(KCL)

Kinesis Data Streamからレコードを取得して、レコードプロセッサ と呼ばれるレコードを処理するためのハンドラをアプリケーション。EC2などの上で常駐させる。アプリケーションの開発者はこの レコードプロセッサ に処理を実装するだけで良く、レコードの取得、どのレコードまで処理したかの状態、Kinesisストリームのシャード増減を自動的に管理してくれる。

●Kinesis Producer Library(KPL)

Kinesis Data Streamsが提供するライブラリ。データストリームへの書き込みプロセスを簡素化する。 バッチ処理、集約、自動再試行などの機能を提供し、データ取り込みの効率性と信頼性を向上させる。

[データ処理によって、複数回のレコードが送信される理由]

Kinsis系のサービスではストリーミング処理を失敗した場合に、プロデューサーが断続的に再起動され複数回送信されてしまう場合がある。重複させないために主キーをレコード内に埋め込み、それぞれのレコードをユニークにする(同じものの存在を1つしか許さない状態)必要。下記2点についてはアプリケーション側で設計時に複数回送信されることを想定される。

- プロデューサーの再試行

- コンシューマーの再試行

連携サービス

| Lambda | Lambda 関数を使用すると、Kinesis DataStreams のレコードを高速処理できる。Kinesis データストリームは、シャードのセット。Lambda 関数を共有スループットコンシューマー (標準イテレーター) にマップすることも、拡張ファンアウトを使用する専用スループットコンシューマーにマップすることもできる。 |

| Application Auto Scaling | Application Auto Scalingを利用することでKinesis Data Stream に対してシャードを自動的に追加・削除する。スケーリングポリシーを定義を利用することでKinesis Data Stream に対してシャードを自動的に追加・削除するスケーリングポリシーを定義する。 |

Kinesis Data Firehose

完全マネージド型サービス(ゼロ管理)。設定を行うだけで、次々と送られる大量のデータをRedShiftやS3に流し込むサービス。分析用途であり、大量のデータを効率よく格納する圧縮技術やいかにセキュアにデータを保持するかに向いている。アプリケーションの構築なしに設定を行うだけでS3、Redshift,Elastic searchに自動的にデータを収穫・格納できる。

※データのリアルタイム分析を直接実行する機能はない

・Lambda関数と統合されており、Lambda関数によるELT処理を連携することでデータ変換しつつ配信処理を実行できる。

●サブスクライバー

Marketplaceで提供されているソフトウェアやサービスを契約して利用しているユーザー。

機能概要

| 動的パーティショニング | データ内のキーを使用して、Kinesis Data Firehose でストリーミングデータを継続的にパーティショニングし、これらのキーでグループ化されたデータを対応する S3 プレフィックスに配信できる。これにより、Athena , EMR ,Redshift Spectrum などのさまざまなサービスを使用して、S3のストリーミングデータに対して高機能でコスト効率の高い分析を簡単に実行できる。 |

| ゼロバッファリング | ほぼリアルタイムでデータを配信できるオプション。従来の Firehose は、データを一定時間(最小60秒)バッファリングしてから S3 や Redshift などに配信していたが、バッファ時間を0秒(0〜900秒 の範囲)に設定可能となり、数秒以内にデータを配信できる。 (リアルタイム性が求められるユースケースに最適) ・追加処理(変換など)がない場合、5秒以内に配信できる ・Lambda変換にもゼロバッファリング対応 |

Kinesis Video Streams

【動画処理】

動画を処理する。

Kinesis Data Analytics

【分析】収集したデータを可視化・分析。

リアルタイムのストリーミングデータの分析や処理、保存を行う。

Managed Grafana

【Grafana専用】

複数のソースからの運用メトリクス、ログ、トレースを即座に照会、関連付け、視覚化する。

拡張可能なデータサポートに対して定評があり、広く展開されているデータ視覚化ツールである Grafana を簡単に展開、運用、スケールできる。

| ★Grafana(グラファナ)とは 分析およびインタラクティブな視覚化を可能にする、マルチプラットフォームで動作するオープンソースのWebアプリケーション |

ワークスペースと呼ばれる論理的に分離された Grafana サーバーを作成する。

シングルサインオン、データアクセスコントロール、監査レポートなど、コーポレートガバナンス要件に準拠するためのセキュリティ機能が組み込まれている。

MSK

【Apache Kafka専用】※MSK:Managed Streaming for Apache Kafka

Apache Kafkaをベースにした完全マネージドのストリーミングサービス。

| ★Apache Kafka オープンソースの分散ストリーム処理プラットフォームで、リアルタイムのストリームデータを扱うためのツール |

・可用性が高く、クラスターは最新の状態に保たれる。

・拡張性が高く、必要に応じて規模を換えることができる。

・Apache Kafka クラスターを複数のアベイラビリティーゾーン (AZ) に分散して提供する。

・既存アプリケーションで処理しているメッセージング機能をクラウドにすばやく簡単に移したい場合に最適。

| Broker(ブローカー) | Kafkaクラスタを構成するサーバーのこと。 |

| Topic(トピック) | メッセージを格納するための論理的な単位。データはTopicに分類される。 |

| Producer(プロデューサ) | Kafkaにメッセージを送信するアプリケーション。 |

| Consumer(コンシューマ) | Kafkaからメッセージを取得するアプリケーション。 |

[引用元]

[処理手順]

★以下を処理実行する

1:サーバーのプロビジョニング

2:Apache Kafka クラスターの設定

3:障害時のサーバーの交換

4:サーバーのパッチとアップグレードのオーケストレート

5:高可用性のためのクラスターの構築

6:データの永続的な保存とセキュリティの確保

7:モニタリングとアラームの設定

8:負荷変動をサポートするためのスケーリングの実行

MSF

【Apache Flink専用】※Managed Service for Apache Flink

Apache Flink を使用してストリーミングデータをリアルタイムで変換および分析し、アプリケーションを他の AWS サービスと統合できる。管理するサーバーやクラスターはなく、コンピューティングやストレージのインフラストラクチャをセットアップする必要もない。

・複雑なストリーム処理に適している。

●RANDOM CUT FOREST

データストリーム内の異常を検出する。

分析サポートサービス

Glue

【データ変換】

サーバレス型分析サービス。データ管理と変換する機能。データの加工などを行う、ETL(抽出・変換・格納)サービスであり、主にデータを分析する前に使うサービス。 データソースのデータを探索し、メタデータとして管理する。

[組み込み変換]

データを処理するために使用できる一式の組み込み変換を用意。これらの変換はETLスクリプトから呼び出すことができる。データは変換から変換へとDynamicFrameと呼ばれるデータ構造で渡される。

| Data Catalog | メタデータを格納するデータストア(=メタデータストア)。データベースやテーブルといった構造で保管する。S3 などのデータソースに保存されている構造化データ、または半構造化データの集まりをメタデータとして管理する。データカタログには、データベース、テーブル、スキーマといった構成を持ち、コネクション、クローラー、分類子といったメタデータを抽出するための機能がある。 |

| Crawler | データソースへの接続、データスキーマの推測、データカタログでメタデータテーブル定義の作成を行うプログラム |

| ETL Job | ソースからデータの抽出、Apache Spark スクリプトを使用して変換、ターゲットにロードするビジネスロジック |

[公式参考サイト]

Dynamic Frame

AWS Glue専用のデータ構造。SparkのDataFrameと似ていますが、1つのカラム(列)に複数の異なるデータ型を混在させられるという高い柔軟性が最大の特徴。

[主な機能と特徴]

生データの複雑なETL処理を簡単にするために設計されています。複数のデータ型候補を「Choice型」として保持し、後の処理で型を決定できます。SparkのDataFrameと相互に変換可能。一般的に、データの読み書きはDynamicFrameで行い、途中の複雑なデータ変換はDataFrameに変換して行うことが多い。

[構造]

DynamicFrameがデータ全体(テーブル)を表し、その中の1行のデータをDynamicRecordと呼ぶ。

Glue Find Matches

機械学習を使って類似レコードを検出する機能。特に、完全一致しないデータ(名前のスペル違いや住所の表記揺れなど)でも、同一人物や同一商品などを見つけたいときに活躍する。

[特徴]

・主キーや完全一致がなくても類似レコードを検出可能

・ラベル付きデータを使って機械学習モデルをトレーニング

・match_id列を付与して、同一グループのレコードを識別

・重複排除やインクリメンタルマッチングにも対応

Lake Formation

データレイクの構築・管理・アクセス制御を簡素化するマネージドサービス。S3 上のデータに対して詳細なアクセス制御が簡単に設定できる。構造化・非構造化データを一元管理できる。

- アクセス制御を強化:IAM とは別の独自の権限モデルで、列・行・セルレベルまで細かく制御

- セキュリティとガバナンスの向上:企業全体でのデータ共有と制限を両立

- Lake Formation タグ を使ってデータを分類・ラベル付けし、リソースアクセスをキャンペーン単位などで制限可能。

- AWS Glue Data Catalog や Amazon Athena と連携し、統合的なメタデータ管理やアクセス制御を実現。

[主な機能と構成要素]

| コンポーネント | 説明 |

|---|---|

| データカタログ | Glue と共有するメタデータ管理機構。S3 上のデータをテーブルとして定義 |

| アクセス制御 | LFタグ方式(タグベース)とリソース方式(個別付与)の2種類 |

| ブループリント | データ取り込みのテンプレート。Glue のクローラーやジョブを自動生成 |

| ワークフロー | データ取り込みや変換処理の流れを定義。Glue のトリガーと連携 |

| プリンシパル | IAMユーザーやロールに対応。Lake Formation 独自の管理者権限も存在 |

LF-TBAC

[Lake Formation のタグベースアクセス制御 (LF-TBAC)]

- LF-TBAC は、属性(タグ)に基づいて許可を定義する仕組み。

- LF タグは Data Catalog リソース、Lake Formation プリンシパル、テーブル列などに付与可能。

- プリンシパルのタグがリソースタグと一致したときに操作を許可する。

- 急成長する環境やポリシー管理が複雑な状況で有効。

- IAM の属性ベースアクセス制御 (ABAC) と連動し、細粒度アクセスを提供。

[メリット]

・名前付きリソース方式よりも柔軟で効率的。

・リソースが多数あってもスケーラブルに管理可能。

ADOT

※AWS Distro for OpenTelemetry

AWSが公式に提供する OpenTelemetry のディストリビューションで、クラウドネイティブな監視とトレーシングを簡単に実現するためのツールセット。

| 項目 | 内容 |

|---|---|

| 目的 | アプリケーションのメトリクス、ログ、トレースを収集・送信するための統合ソリューション |

| ベース技術 | CNCF(Cloud Native Computing Foundation)プロジェクトの OpenTelemetry |

| 特徴 | AWSサービスとの統合が強力(X-Ray、CloudWatch、ECS、Lambda など) |

| コンポーネント | OpenTelemetry Collector(AWS対応版)、SDK(Java, Python, Go など) |

[メリット]

・AWSリソースのメタデータ取得:アプリケーションとインフラの関連付けが可能で、トラブルシューティングが高速化

・一度の計装で複数サービスに送信:X-RayやCloudWatchなど、複数の監視ツールに同時にデータを送れる

・サイドカーやエージェントとして柔軟にデプロイ可能:ECS FargateやEC2、Lambdaなどに対応

キューイングサービス

ストリーム処理をかけるデータはキューイングサービスを通すことが一般的である。

SQS

(Simple Queue Service)

キュー内の(複数の)ワーカープロセスでメッセージを処理し、確実な非同期(分散並行)処理を行う。キューの有効期限が切れるまで繰り返し処理する。

| プロデューサ | キューにメッセージを入れる、取り出すサービス。 |

| エンドポイント | URLを介して送受信する。 |

キュー

メッセージを管理する入れ物のようなもの(256KB限度)デフォルトは4日間保存する。キューは手動で削除することが可能。

| スタンダードキュー | 順番は保証されない。一回のメッセージ配信をサポートする。 ・シーケンス情報 追加することで、順序良く受信させることができる。(スタンダードキュー可能) |

| 先入れ先出し(FIFOキュー) | 利用料金は高め。受信時にメッセージの並び替え、最低1回のメッセージ配信をサポートする。 ・S3との連携はできない ・1秒あたり最大3,000トランザクション ・1秒あたり最大300メッセージをサポートする [キューの切り替え] FIFOキューに切り替えるなどする際は、新しくキューを作成する必要がある。 ※FIFOキューは「コンテンツベース重複排除」を有効化することで、データを一意にできる |

その他機能

| キューイング (待ち行列) | 【一時退避】一時的に送信するデータをデータ領域に保持し、滞留させず確実に相手へ届ける。疎結合が可能。 |

| デッドレターキュー (DLQ) | 【失敗処理】処理できないメッセージを別のキューに移動させる。正常に処理 (消費) できないメッセージのターゲットとする。アプリケーションやメッセージングシステムのデバッグに役立つ。 |

| 遅延キュー | 【受信遅延】キューへの新しいメッセージの配信を数秒間遅延させ、そのキューに送信したすべてのメッセージは遅延期間中にコンシューマーに表示されない。キューのデフォルト (最小) 遅延は 0 秒。最大値は15分。 |

メッセージ

キューの中に格納される情報。

●メッセージグループ ID

【メッセージのタグ付け】

メッセージが特定のメッセージグループに属することを指定するタグ。 同じメッセージグループに属するメッセージは、そのメッセージグループに関連して厳密な順序で 1つずつ処理される。

●可視性タイムアウト

【重複受信防止】

メッセージの受信中に他クライアントが受信しないように防止する(30秒~12時間まで延長可能)。メッセージは受信しただけでは消えず、クライアント側から削除指示を受けた時のみ削除される。

- ChangeMessageVisibility

新しいタイムアウト値を指定すると、メッセージの可視性を短縮または拡張できる。 - VisibilityTimeout

メッセージが1回受信された後、他のクライアントから同じメッセージを受信不可にするための時間。

(デフォルトは30秒. 値は0〜43,200(12時間) の間で設定可能) - ReceiveMessage

リクエストによってメッセージを取得。

●SQS Java 拡張クライアントライブラリ

【メッセージの保存管理】

メッセージを常に S3 に保存するか、メッセージのサイズが 256 KB を超える場合のみ保存するかを指定する。

・S3 バケットに保存されている単一のメッセージオブジェクトを参照するメッセージを送信する

・S3 バケットからメッセージオブジェクトを取得 / 削除する

ポーリング

複数のキューを呼び出して分散してメッセージを処理する。ただし、1つのキューにすべてのメッセージが入っているわけではない。

キューの中の先頭のデータが渡されるため、中の特定のメッセージを指定できない。

[参考]

| ショートポーリング | メッセージ取得時に特定のキューをランダムに選択し、そのキューからメッセージを取得する。リクエストを投げると結果は直ぐに返ってくるため、メッセージ取得時の待機時間0秒。しかし、結果が0件だった場合はリトライされるため、リクエスト回数が増え、料金が増加する。 |

| ロングポーリング (推奨) | すべてのキューを確認し、処理可能な(待機時間を超過した)メッセージが存在する場合と接続タイムアウトになった場合のみ結果を返す。結果が0件の場合は返答しないため、SQS使用時のコストを削減できるので、ショートポーリングよりも推奨される。 ※ReceiveMessageAPI アクションが 0 より大きい場合ロングポーリングは実行中 ・KMSを使用したサーバー側の暗号化を使用したシームレスな保存データの暗号化をサポート。一元化されたキー管理が可能になる。 |

メトリクス

[参考公式サイト]

[AWS SQSで利用可能なCloudWatchメトリクス]

| メトリクス名 | 説明 |

| ApproximateNumberOfMessagesVisible | キュー内で現在可視状態にある(取得可能な)未処理メッセージの数。消費対象としてすぐに取得可能。 |

| ApproximateNumberOfMessagesDelayed | 遅延状態にあるメッセージの数。DelaySecondsが設定されており、まだ可視でないもの。 |

| ApproximateNumberOfMessages(属性) | CloudWatchメトリクスではなく、SQSキュー属性。Visible、Delayed、NotVisibleをまとめた情報をAPIで取得可能。 |

MQ

【Apache用】

Apache ActiveMQ および RabbitMQ 用マネージド型のメッセージキューイングサービス。AWS独自の方法ではなく業界標準APIやメッセージング用プロトコルを使ってるため、今までのアプリから接続先をMQに変えるだけで簡単に移行できる。リージョン内の複数のAZにメッセージを冗長的に保存するため、耐障害性が高い。

・ソフトウェアをインストールして管理したりする必要はない。

・ソフトウェアのアップグレードやセキュリティの更新、障害の検出と回復などのタスクを自動的に管理する。

●メッセージブローカー

【中間システム】

異なるシステム間でメッセージやり取りの時、直接データのやり取りせず、中間システムとしてメッセージ格納領域を管理する機能。

その他関連サービス機能

IAM Access Analyzer

【意図せぬ公開】